J’ai failli perdre un client à cause de GPT-5. Pas parce que le modèle est mauvais — parce que je l’avais choisi pour les mauvaises raisons. Si vous lisez ce comparatif GPT-5 vs Claude 4 en cherchant “le meilleur”, vous posez déjà la mauvaise question.

21 minutes. Le chiffre qui a tout changé.

Migration d’un système de reporting financier vers un agent IA. Client grand compte, budget conséquent, deadline serrée. J’avais misé sur GPT-5 — l’écosystème MCP d’OpenAI semblait inarrêtable, les démos YouTube étaient bluffantes. Résultat : 21 minutes pour générer un tableau trimestriel avec des lignes manquantes.

Claude Opus 4.6, même prompt, même contrainte : 4 minutes, zéro oubli.

Je dis le chiffre deux fois parce que je l’entends encore résonner dans cette salle de réunion. Cette expérience m’a appris une chose qu’aucun benchmark ne te dira jamais : les modèles sont performants dans des contextes différents, pas dans tous les contextes.

Alors avant de comparer les chiffres, posez-vous une question honnête : vous construisez quoi, exactement ?

Ce que les benchmarks disent vraiment — et ce qu’ils taisent

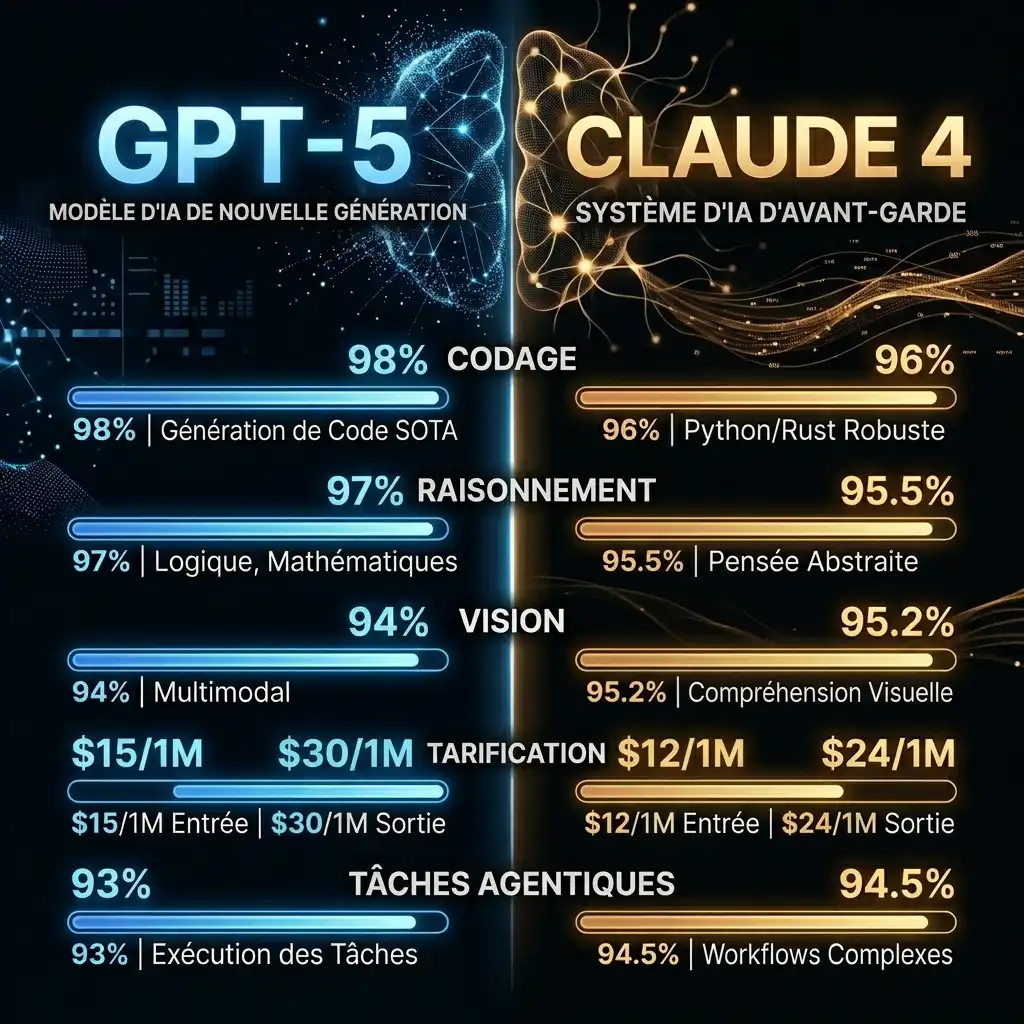

Sur SWE-bench Verified — résolution de vrais bugs en conditions réelles — Claude Opus 4.6 tient 80,8% contre 77,2% pour GPT-5.4. Trois points d’écart. Rien de spectaculaire. Mais sur SWE-bench Pro, le benchmark des bugs qui font souffrir des équipes seniors depuis des semaines, GPT-5.4 explose à 57,7% contre environ 45,9% pour Claude. Là, l’écart est réel.

Sur le raisonnement scientifique de haut niveau (GPQA Diamond), Claude prend l’avantage : 87,4% contre 83,9%. Sur le contrôle d’ordinateur et l’automatisation bureau (OSWorld), GPT-5.4 dépasse le niveau humain à 75% — Claude suit à 72,7%. Et sur le raisonnement visuel complexe (MMMU-Pro), Claude reprend la main : 85,1% contre 81,2%.

| mark | Claude Opus 4.6 | GPT-5.4 | Ce que ça mesure vraiment |

|---|---|---|---|

| SWE-Bench Verified | 80,8% | 77,2% | Bugs courants en production |

| SWE-Bench Pro | 45,9% | 57,7% | Bugs complexes, raisonnement multi-étapes |

| GPQA Diamond | 87,4% | 83,9% | Raisonnement scientifique expert |

| OSWorld (automatisation) | 72,7% | 75% | Contrôle OS et navigateur |

| MMMU-Pro (vision) | 85,1% | 81,2% | Analyse visuelle complexe |

La colonne qui change tout, c’est la troisième. Parce que “bugs courants” et “bugs complexes”, c’est deux métiers différents.

Ce que personne ne calcule avant de signer

Un directeur technique d’une scale-up SaaS, quelques millions de requêtes de support client par mois. Je lui recommande Claude. Il revient trois jours plus tard avec un tableur. La différence de coût entre les deux modèles représentait 40 000 € annuels pour son volume. Il a choisi GPT-5.4 avec des garde-fous humains sur les cas sensibles.

J’aurais pu lui dire qu’il avait tort. Il avait raison.

GPT-5.4 démarre à 2,50 $ par million de tokens en entrée, 15 $ en sortie. Claude Opus 4.6 : 5 $ en entrée, 25 $ en sortie. Et si votre contexte dépasse 200 000 tokens, Claude double encore : 10 $ en entrée, 37,50 $ en sortie. Sur les tâches de codage standard, GPT-5.4 consomme aussi 47% moins de tokens que Claude sur des requêtes comparables — ce qui le rend environ 6 fois moins cher à l’usage réel.

Pour une PME qui expérimente, la différence est négligeable. Pour une infrastructure agentique qui tourne à l’échelle industrielle, c’est une décision stratégique qui se chiffre en dizaines de milliers d’euros par an.

La position impopulaire que je défends

Voilà ce que je pense sincèrement, et ça va contrarier quelques consultants IA : le duel GPT-5 vs Claude 4 est une fausse guerre. Ces deux modèles ne s’affrontent pas, ils répondent à deux philosophies d’usage fondamentalement différentes.

Claude Opus 4.6 est un outil de précision cognitive. Son style de réponse est nuancé, conversationnel, proche de la collaboration humaine. Sa gestion des grandes codebases via les “Agent Teams” — plusieurs agents en parallèle qui coordonnent autonomement — n’a pas d’équivalent côté OpenAI. Pour du raisonnement scientifique, de la refactorisation sur un million de tokens de contexte, de la planification multi-étapes ou des workflows créatifs exigeants, il n’a pas d’égal aujourd’hui.

GPT-5.4, lui, est une machine à exécuter. Précis, littéral, discipliné — il respecte les contraintes négatives mieux que n’importe quel autre modèle (“ne pas utiliser X”, “limiter à Y tokens”). Son contrôle natif de l’ordinateur, sa capacité à orchestrer des outils MCP à grande échelle et son rapport qualité-prix imbattable en font le choix rationnel pour les automatisations à fort volume.

Est-ce que votre cas d’usage demande de la profondeur cognitive ou de la puissance d’exécution à l’échelle ? La réponse à cette question vaut 40 000 € par an.

Le tableau de décision que vous cherchiez

| Votre profil | Choisissez | Pourquoi |

|---|---|---|

| Développeur solo, tâches variées | GPT-5.4 | Un modèle, faible coût, large capacité |

| Lead dev, grande codebase | Claude Opus 4.6 | Agent Teams, contexte long, fiabilité |

| Startup soucieuse des coûts | GPT-5.4 | 6x moins cher, 47% moins de tokens |

| Entreprise, code critique | Claude Opus 4.6 | Leader SWE-Bench Verified, fiabilité prouvée |

| Automatisation bureau / OS | GPT-5.4 | OSWorld 75%, dépasse le niveau humain |

| Raisonnement scientifique | Claude Opus 4.6 | GPQA Diamond 87,4% |

| Support client à fort volume | GPT-5.4 | Coût 2x inférieur à l’échelle |

Ce qui devrait vraiment vous inquiéter

Les deux modèles sortiront des mises à jour majeures avant l’été. Une partie de ce comparatif sera dépassée dans trois mois — c’est la cadence de ce marché en 2026. Et pourtant, la plupart des équipes que je croise choisissent un modèle une fois, l’intègrent dans leur stack, et n’y reviennent jamais.

La vraie compétence à développer, ce n’est pas de savoir lequel des deux est “le meilleur”. C’est d’avoir construit une architecture qui permet de switcher sans douleur quand le rapport de force change. Et il changera — probablement plus tôt que vous ne le pensez.

Avant de finaliser votre choix, calculez votre volume mensuel de tokens. C’est le seul chiffre qui transforme ce comparatif en décision réelle.

Les questions que tout le monde se pose — mais que personne ne pose franchement

GPT-5 est-il vraiment meilleur que Claude 4 ?

Ni l’un ni l’autre n’est “meilleur” de façon absolue — et quiconque vous dit le contraire vous vend quelque chose. GPT-5.4 domine sur les mathématiques avancées (FrontierMath : 47,6% contre 27,2% pour Claude), le contrôle d’ordinateur et les workflows agentiques à fort volume. Claude Opus 4.6 prend l’avantage sur le raisonnement scientifique, la compréhension de grandes codebases, la rédaction longue forme et l’analyse documentaire. La bonne question n’est pas “lequel est meilleur ?” mais “meilleur pour quoi ?”

Lequel choisir pour coder ?

Claude Opus 4.6 reste le référent sur SWE-bench Verified — le benchmark qui mesure la résolution de vrais bugs en production — avec 80,8% contre 77,2% pour GPT-5.4. Mais si vous travaillez sur des bugs très complexes ou de la recherche multi-étapes, GPT-5.4 reprend l’avantage sur SWE-bench Pro (57,7% contre 45,9%). Pour du prototypage rapide et économique : GPT-5.4. Pour de la refactorisation sur une grande codebase d’entreprise : Claude Opus 4.6.

Claude 4 est-il meilleur en français ?

Oui, et c’est une différence qui compte si votre audience est francophone. Claude Opus 4.6 surpasse GPT-5.4 sur le multilinguisme, notamment en français, avec une meilleure fluidité stylistique et une compréhension des nuances culturelles. GPT-5.4 reste très compétent mais produit des tournures parfois plus “traduites” sur des textes longs.

Quel est le prix de GPT-5 vs Claude 4 ?

GPT-5.4 est facturé 1,25 $ par million de tokens en entrée et 10 $ en sortie dans sa version standard. Claude Opus 4.6 coûte 5 $ en entrée et 25 $ en sortie — quatre fois plus cher à l’entrée. Pour les contextes longs dépassant 200 000 tokens, Claude passe à 10 $ en entrée et 37,50 $ en sortie. Sur des tâches de codage répétitives, GPT-5.4 consomme aussi environ 47% moins de tokens, ce qui le rend environ 6 fois moins cher à l’usage réel.

GPT-5 peut-il générer des images, contrairement à Claude 4 ?

Oui. C’est une différence fonctionnelle majeure que les comparatifs oublient souvent : GPT-5 est nativement multimodal — texte, image, audio — là où Claude 4 se concentre sur les capacités analytiques et textuelles. Si votre workflow intègre de la génération visuelle ou du traitement audio, GPT-5.4 est le seul choix possible aujourd’hui.

Claude 4 est-il plus sûr que GPT-5 pour un usage en entreprise ?

C’est là où Anthropic a construit son avantage concurrentiel depuis le départ. L’approche Constitutional AI d’Anthropic rend Claude Opus 4.6 plus prévisible sur les secteurs réglementés — santé, finance, juridique — et plus aligné sur les exigences RGPD. OpenAI a fait des progrès substantiels sur ce terrain, mais Claude conserve une longueur d’avance en matière de cohérence des garde-fous sur des contextes longs et sensibles.

Peut-on utiliser les deux modèles en parallèle ?

Non seulement c’est possible, c’est probablement la stratégie la plus intelligente en 2026. Plusieurs équipes techniques combinent GPT-5.4 pour les tâches agentiques à volume et Claude Opus 4.6 pour les tâches à haute exigence cognitive. Les APIs des deux modèles sont accessibles via des agrégateurs comme APIYI, ce qui permet de router dynamiquement les requêtes selon leur nature sans reconstruire toute l’architecture.

Qu'est-ce qu'OpenAI ? Modèles, outils et agents IA – Techbox.fr

8 avril 2026[…] loin sur Techbox.fr :→ Guide complet des modèles OpenAI : lequel choisir selon votre usage→ GPT-5 vs Claude 4 : lequel choisir selon ton usage→ OpenAI API : tutoriel débutant en français→ OpenAI Agents : comment automatiser vos […]