Trois mille euros. C’est ce qu’a coûté, en fin d’année 2024, un pipeline RAG mal architecturé pour un client parce que quelqu’un avait décidé d’utiliser le modèle “le plus puissant” sans se demander si c’était le bon. Pas une erreur technique. Une erreur de jugement. Et si je vous disais que la même erreur vient de devenir encore plus coûteuse, maintenant qu’OpenAI a officiellement reconfiguré son écosystème entier ?

À retenir

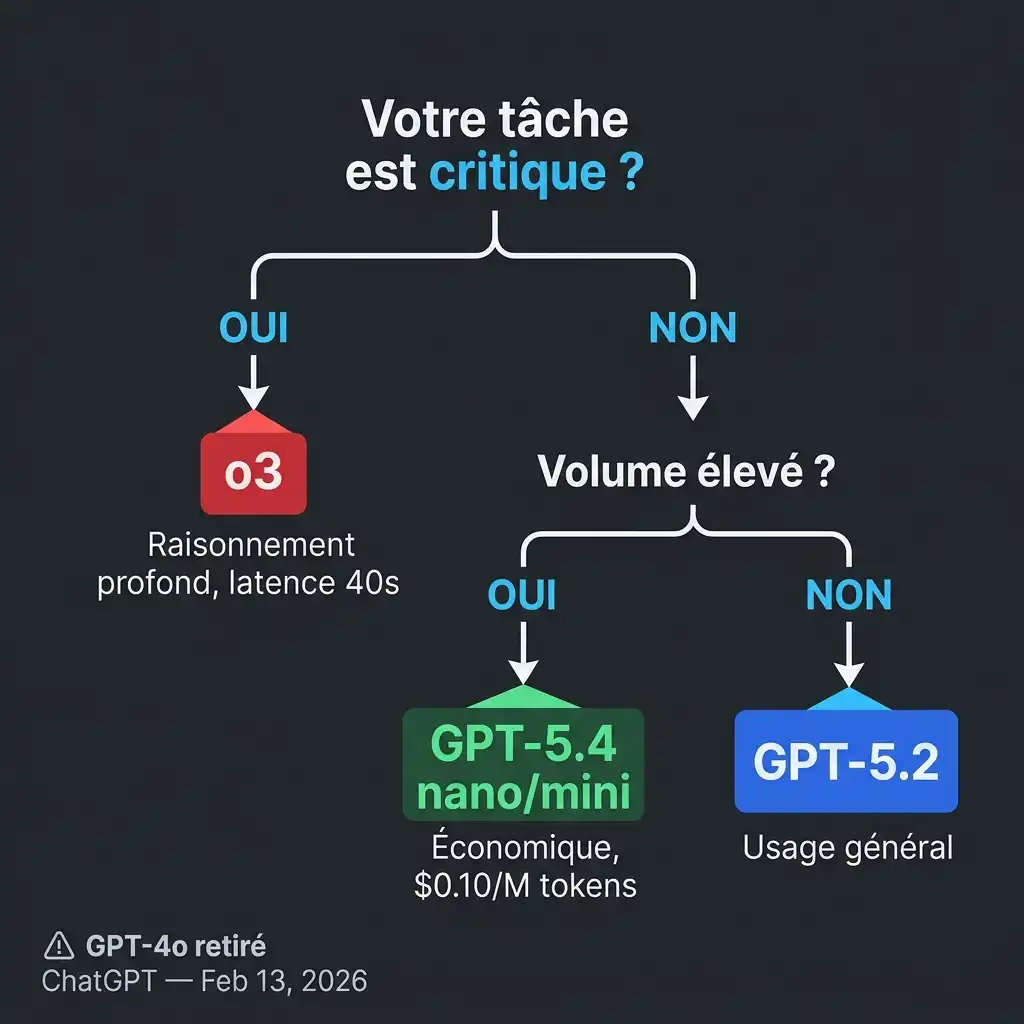

GPT-4o, GPT-4.1 et o4-mini ont été retirés de ChatGPT le 13 février 2026 ; ils restent accessibles via API sans date de fin annoncée. GPT-5.2 est le nouveau socle de référence pour l’usage quotidien, pendant que GPT-5.4 mini redéfinit le rapport qualité/coût pour les pipelines à fort volume. o3 conserve sa place incontestée pour le raisonnement critique à zéro tolérance à l’erreur. Les modèles open-weight restent la troisième voie stratégique pour toute organisation qui ne peut pas se permettre de subir les cycles de dépréciation d’un fournisseur tiers.

Ce qui vient de basculer

Le 13 février 2026, OpenAI a retiré GPT-4o, GPT-4.1, GPT-4.1 mini et o4-mini de ChatGPT. Officiellement. Sans retour arrière annoncé. La justification ? Seulement 0,1% des utilisateurs choisissaient encore GPT-4o chaque jour — la grande majorité avait déjà migré vers GPT-5.2 sans même s’en apercevoir.

e chiffre devrait vous faire réfléchir. Pas parce que GPT-4o était mauvais — il était excellent. Mais parce qu’il illustre à quelle vitesse un modèle “de référence” peut devenir fantôme dans les usages réels. Ces modèles restent disponibles via l’API pour l’instant, OpenAI ayant précisé qu’aucun changement n’est prévu côté développeurs sans préavis. Mais la direction est claire : l’ère GPT-4 est terminée dans les interfaces grand public.

Votre workflow repose encore sur un modèle retiré de ChatGPT ? Demandez-vous combien de temps encore l’API vous laissera cette béquille.

L’illusion du modèle universel

Pendant longtemps, j’ai fait comme tout le monde : GPT-4o par défaut, pour tout. Rédaction d’articles, débogage Python, analyse contractuelle, chatbots. Ça marchait. Jusqu’au jour où j’ai reçu une facture API qui m’a forcé à tout repenser — et jusqu’au 13 février 2026, date à laquelle ce réflexe est devenu officiellement obsolète.

Le catalogue OpenAI ne s’est pas simplement étoffé : il a muté, puis il a élagué. Quatre grandes familles coexistaient — les généralistes GPT-4.x, les raisonneurs o3/o4, les multimodaux et les open-weight. Aujourd’hui, OpenAI centralise ses ressources sur GPT-5 et ses déclinaisons, reléguant toute la génération précédente au statut de legacy. Ce n’est plus un catalogue, c’est une feuille de route — et si vous ne la lisez pas, c’est elle qui vous lira.

Avant de continuer : combien de fois avez-vous choisi un modèle parce qu’il était “le meilleur” selon un benchmark ? Et combien de fois ce benchmark ressemblait à votre vrai cas d’usage — et pas à celui d’il y a six mois ?

Ce que GPT-5.x change concrètement

GPT-5.2 est désormais le modèle de référence pour l’usage quotidien dans ChatGPT. GPT-5.4 mini — sorti en mars 2026 — améliore significativement son prédécesseur sur le coding, le raisonnement et la compréhension multimodale, tout en tournant plus de deux fois plus vite. La vraie question n’est pas “sont-ils meilleurs ?” (oui) — c’est “est-ce que votre cas d’usage justifie le coût du haut du spectre ?”

Pour du développement logiciel complexe ou de la recherche à zéro tolérance à l’erreur, GPT-5 Pro reste indispensable. Pour le reste, GPT-5.4 mini est la Ferrari rendue accessible — et déployer GPT-5 Pro sur un chatbot FAQ reste aussi absurde qu’avant.

Et si le vrai risque n’était pas de choisir un modèle trop faible, mais de continuer à penser que “plus puissant” signifie automatiquement “meilleur pour vous” ?

Ce que les anciens modèles ont laissé derrière eux

La série o3 reste disponible pour le raisonnement critique. C’est le spécialiste du multi-étapes complexe — mathématiques, jurisprudence, sciences dures. Il est lent, coûteux, et souvent indispensable quand une erreur est inacceptable. Sa place dans l’écosystème n’a pas changé ; c’est tout le reste autour de lui qui a bougé.

Une anecdote qui m’a appris quelque chose d’important : un client dans le secteur juridique avait construit son pipeline RAG sur 1 200 pages de jurisprudence en utilisant uniquement o3 pour chaque requête. Résultat — des réponses d’une précision remarquable, une latence de 40 secondes, et une facture mensuelle à cinq chiffres. La réécriture avec GPT-5.4 mini pour la navigation documentaire, GPT-5.2 pour la génération des réponses, et o3 comme “LLM-juge” de vérification finale a réduit les coûts de 70% sans sacrifier la qualité.

Vous pensez que o3 est “trop cher” pour votre projet. Mais avez-vous calculé ce que vous coûte une erreur non détectée — en temps, en réputation, en retraitement ?

Le tableau de décision post-13 février

| Besoin | Modèle recommandé | Ce qu’il faut éviter |

|---|---|---|

| Usage quotidien généraliste | GPT-5.2 | Persister sur GPT-4o (retiré de ChatGPT) |

| Workflows API à fort volume | GPT-5.4 mini / nano | GPT-4.1 mini (retiré de ChatGPT, API encore dispo) |

| Raisonnement critique, sciences | o3 | Le déployer pour des tâches simples |

| Compromis performance/coût API | GPT-5.4 mini | Ignorer la migration post-retrait |

| Applications vocales temps réel | gpt-realtime-1.5 | gpt-4o-realtime (retiré en mai 2026) |

| Génération d’images | GPT Image 1 / DALL·E 3 | — |

| Infrastructure souveraine | gpt-oss-120b / gpt-oss-20b (Apache 2.0) | Dépendre du cloud si données sensibles |

Ce tableau vous semble évident ? Tant mieux. Maintenant demandez-vous pourquoi votre stack actuelle ne le reflète pas encore.

GPT-5.4 et la question du “trop puissant”

GPT-5.4 est sorti le 5 mars 2026 avec une architecture qui change concrètement les règles du jeu. Il intègre un mode Thinking natif, des capacités de computer use, et une fenêtre de contexte étendue — le tout à un coût inférieur à GPT-5 Pro. La vraie question n’est pas “est-il meilleur ?” (oui) mais “avez-vous un problème qui justifie ce niveau ?”

Pour les équipes qui veulent un contrôle total — données sensibles, conformité stricte, customisation fine — les modèles open-weight gpt-oss-120b et gpt-oss-20b sous licence Apache 2.0 ouvrent une troisième voie que la plupart des comparatifs ignorent. La plupart des DSI aussi, jusqu’au jour où un audit RGPD ou une question de souveraineté des données les force à reconsidérer leur architecture entière.

Votre direction vous demande d’utiliser “le meilleur modèle disponible”. Vous savez maintenant que cette phrase ne veut rien dire — et qu’elle ne tient même plus la comparaison sur six mois d’horizon.

Ce que les benchmarks ne vous diront jamais

Les classements officiels comparent des performances sur des tâches standardisées. Votre tâche à vous ne l’est jamais vraiment. La vraie méthodologie : définir d’abord la tolérance à l’erreur, le volume de requêtes, la contrainte de latence, le budget — et remonter vers le modèle, jamais l’inverse.

Trois mille euros. C’est le prix d’un mauvais réflexe en 2024. En 2026, avec un écosystème qui se reconfigure tous les six mois, ce réflexe est devenu une stratégie délibérément risquée.

Questions fréquentes

GPT-5.4 mini est-il suffisant pour du RAG en production ?

Dans la majorité des cas, oui. GPT-5.4 mini dispose d’une fenêtre de contexte de 400 000 tokens, d’un score de 54,38% sur SWE-Bench Pro — soit à peine 3 points sous GPT-5.4 Standard — et d’un coût environ six fois inférieur au modèle complet. Pour du RAG classique (navigation documentaire, réponse à partir d’un corpus, extraction structurée), il est le choix rationnel. Réservez GPT-5.4 Standard ou o3 comme LLM-juge de vérification sur les outputs critiques, pas comme moteur principal.

Quelle est la différence entre o3 et GPT-5 Thinking ?

Ce sont deux approches du raisonnement qui ne jouent pas dans la même catégorie. o3 est un modèle dédié au raisonnement profond : avant de répondre, il travaille le problème étape par étape en interne, avec une latence de 20 à 60 secondes sur les cas difficiles. GPT-5 Thinking (disponible via GPT-5.4 avec le mode “Extreme”) intègre ce raisonnement dans un modèle généraliste — plus rapide, moins coûteux, mais o3 reste supérieur sur les mathématiques de niveau PhD, la logique formelle complexe et la programmation compétitive. En production, o3 reste le choix quand l’erreur est inacceptable et que la latence n’est pas un critère.

Peut-on encore utiliser GPT-4.1 via l’API après le retrait du 13 février 2026 ?

Oui, GPT-4.1 et ses variantes restent accessibles via l’API OpenAI sans date de dépréciation annoncée à ce jour. Le retrait du 13 février 2026 concerne uniquement l’interface ChatGPT. Pour les pipelines API existants, vous pouvez maintenir GPT-4.1 sans action immédiate — mais prévoir une migration vers GPT-5.4 mini reste prudent, d’autant que le rapport qualité/coût est désormais en faveur du nouveau modèle.

GPT-5.4 nano est-il viable pour autre chose que du routing ?

Plus que vous ne le pensez. GPT-5.4 nano est conçu pour les sous-agents à fort volume et la classification, mais ses capacités de computer use natives le rendent utilisable dans des architectures multi-agents où chaque nœud n’a besoin que d’une tâche simple et rapide. La vraie limite : sa fenêtre de contexte réduite et ses capacités de raisonnement limitées le rendent inadapté à tout ce qui nécessite de maintenir un état conversationnel complexe ou d’analyser de longs documents.

Quel modèle choisir pour une application voix en temps réel après la dépréciation de gpt-4o-realtime ?

gpt-4o-realtime sera retiré en mai 2026. Le successeur direct est gpt-realtime-1.5, conçu pour les applications audio streaming avec une latence optimisée. Pour les usages nécessitant une voix synthétique haute qualité sans interaction temps réel, tts-1-hd reste disponible et performant. Si votre application repose sur du multimodal audio en production, anticipez cette migration avant la date limite, les changements de format de réponse entre les deux modèles nécessitent des ajustements dans la gestion des événements de streaming.

Qu'est-ce qu'OpenAI ? Modèles, outils et agents IA – Techbox.fr

8 avril 2026[…] aller plus loin sur Techbox.fr :→ Guide complet des modèles OpenAI : lequel choisir selon votre usage→ GPT-5 vs Claude 4 : le comparatif tranché→ OpenAI API : tutoriel débutant en français→ […]