OpenClaw vient d’intégrer Mistral AI nativement dans sa version 2026.2.22. Chat, mémoire vectorielle, transcription vocale : la stack Mistral est désormais disponible de bout en bout dans l’assistant IA open source le plus étoilé de l’histoire de GitHub. Ce que ça change concrètement — et pourquoi ça compte.

À retenir

- Mistral AI est maintenant un fournisseur natif dans OpenClaw : chat, embeddings mémoire et voix via Voxtral, tout-en-un

- La mémoire multilingue s’étend à l’espagnol, le portugais, le japonais, le coréen et l’arabe avec recherche BM25 + vectorielle hybride

- Plus de 40 correctifs de sécurité déployés, dont plusieurs CVE à score CVSS élevé corrigés en moins d’une semaine

- Un auto-updater intégré fait son apparition — désactivé par défaut, avec déploiement progressif sur le canal stable

- Le créateur Peter Steinberger rejoint OpenAI et transfère le projet à une fondation open source indépendante

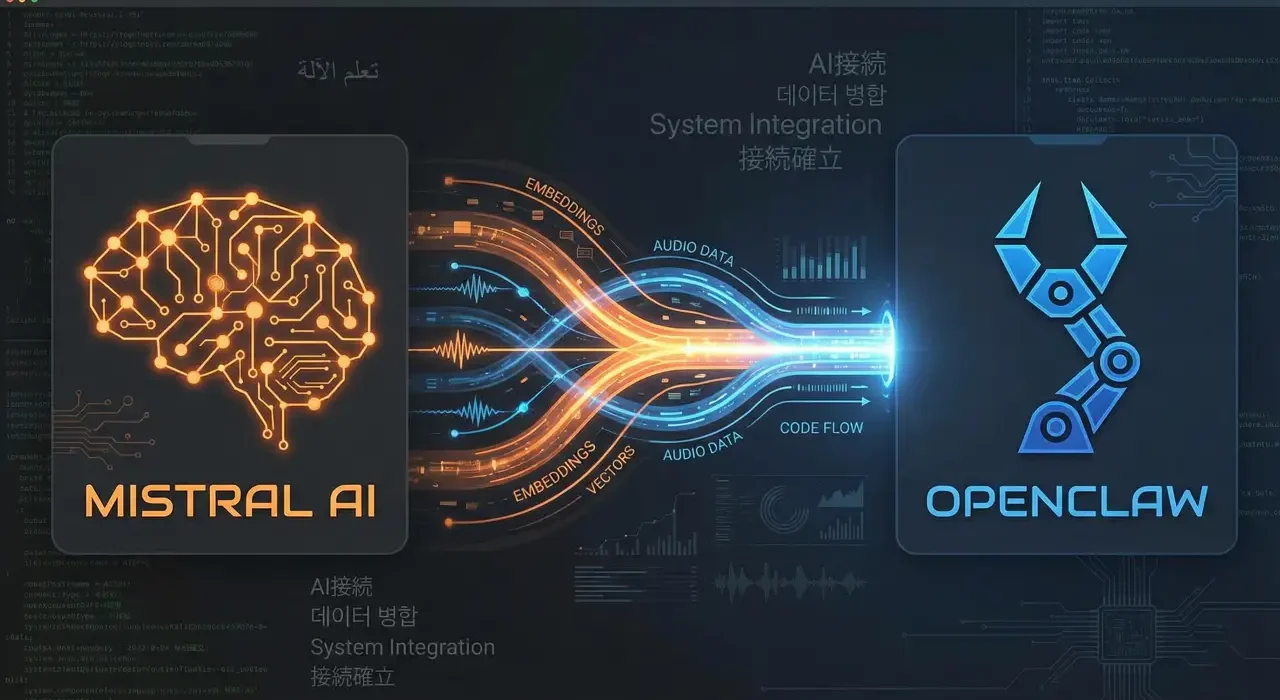

OpenClaw Mistral : enfin natif

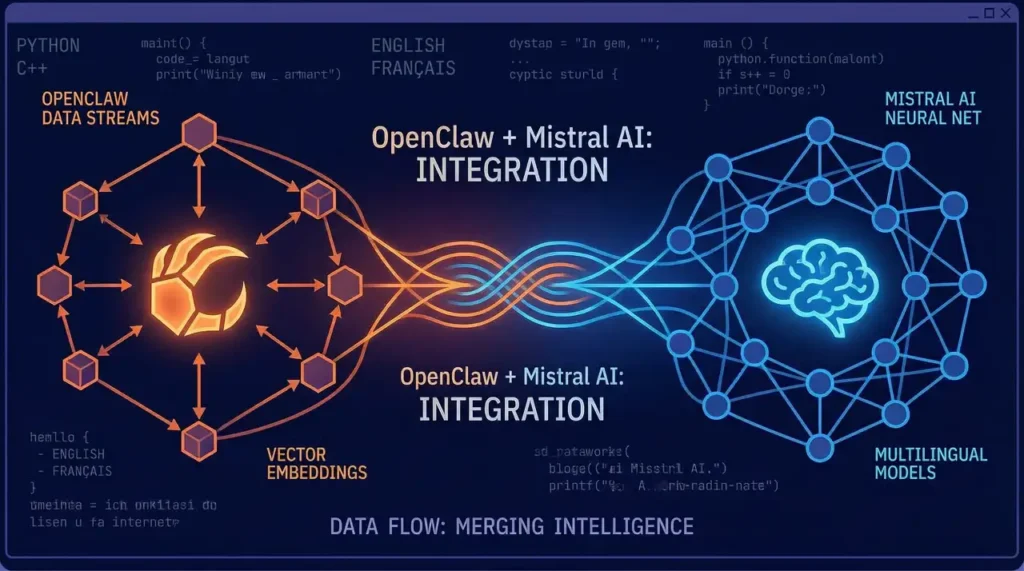

Il y a encore quelques semaines, connecter Mistral à OpenClaw relevait du bricolage. Configuration manuelle, endpoints non documentés, résultats instables. Depuis le 22 février 2026, c’est terminé. L’ingénieur Vincent Koc a livré une intégration complète : routage texte et image, transcription audio via Voxtral, et surtout les embeddings de mémoire vectorielle directement pilotés par les modèles Mistral.

Ce dernier point mérite qu’on s’y arrête. Jusqu’ici, utiliser Mistral pour le chat tout en dépendant d’OpenAI pour les embeddings créait une architecture hybride peu élégante — et coûteuse. Désormais, vos agents LLM peuvent opérer dans un pipeline d’inférence 100% Mistral : ingestion, vectorisation, récupération contextuelle, génération. Une stack cohérente, plus simple à maintenir, plus facile à auditer.

Lors d’une démonstration partagée sur le Discord du projet, un utilisateur a testé Voxtral pour transcrire une réunion tenue simultanément en japonais et en arabe. Le résultat, selon ses propres mots : « presque bluffant, avec quelques approximations sur les noms propres. »

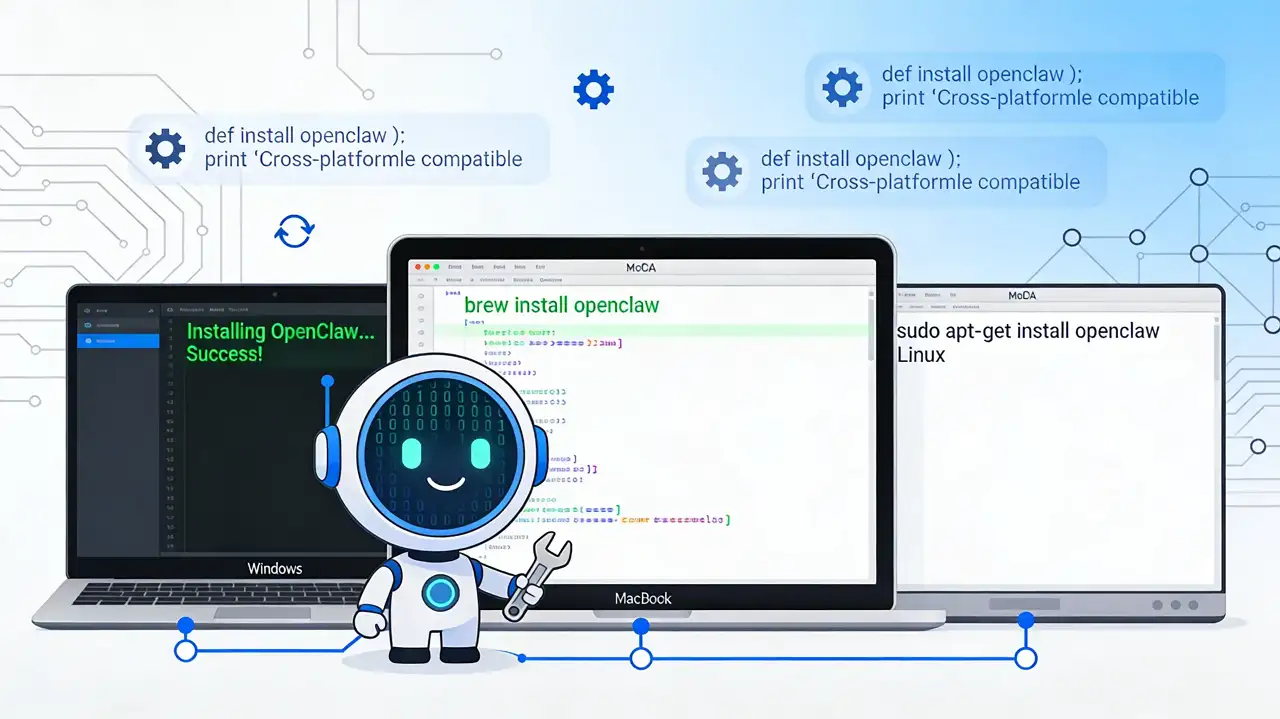

Comment configurer Mistral dans OpenClaw

La configuration se fait depuis le panneau Providers de l’interface. Il suffit de renseigner votre clé API Mistral, puis de sélectionner le modèle souhaité pour chacun des trois usages : chat/routage, embeddings mémoire, et transcription vocale. Les modèles disponibles couvrent l’ensemble de la gamme Mistral — du léger Mistral 7B aux modèles Mixtral pour les tâches de raisonnement complexe.

OpenClaw devient ainsi un véritable orchestrateur multi-LLM : Anthropic Opus et Sonnet avec contexte 1 million de tokens, Google Gemini 3.1, et maintenant Mistral. Pour les utilisateurs qui souhaitent s’affranchir de la dépendance à un seul fournisseur — ou simplement optimiser leurs coûts d’inférence — c’est une évolution structurante.

Mémoire vectorielle multilingue : le vrai saut qualitatif

Le système de mémoire d’OpenClaw repose sur une architecture fichiers Markdown + recherche hybride BM25/vectorielle. Les chunks de contexte d’environ 400 tokens sont stockés avec un overlap de 80 tokens, chaque entrée étant dédupliquée par hash SHA-256 pour éviter les réindexations inutiles. Solide. Mais anglophone.

La version 2026.2.22 corrige cet angle mort avec cinq nouvelles langues : espagnol, portugais, japonais, coréen, arabe. Et pas de manière superficielle. Le pipeline de vectorisation intègre un traitement NLP adapté à chaque morphologie — filtrage des mots vides en coréen avec gestion des particules grammaticales, isolation des scripts RTL pour l’arabe et l’hébreu dans l’interface terminal. Pour les agents déployés dans des workflows RAG (Retrieval-Augmented Generation) sur des bases documentaires non anglophones, c’est probablement la fonctionnalité la plus impactante de cette mise à jour.

40+ correctifs de sécurité : ce qu’il faut savoir

Quarante correctifs en une seule version. Ça impressionne — et ça interroge. Endor Labs a identifié six nouvelles vulnérabilités critiques dans OpenClaw : CVE-2026-26322 (SSRF sur le Gateway, CVSS 7.6), CVE-2026-26319 (authentification manquante sur webhook Telnyx, CVSS 7.5), et une faille RCE par exfiltration de token via WebSocket, CVE-2026-25253, avec un CVSS de 8.8. Toutes corrigées en moins d’une semaine.

Vincent Koc revendique environ 20% des correctifs du noyau et dix soumissions de CVE à son actif. Les vecteurs d’attaque traités dans cette version : injections SSRF dans le pipeline d’URL, prompt injection via captures d’écran navigateur, confinement sandbox pour les synchronisations de compétences, traversée de chemin de session.

Un chercheur indépendant, @lx0f sur GitHub, a publié le post-mortem de sa découverte SSRF : moins de deux heures pour trouver la faille après installation, correctif mergé 72 heures plus tard. « C’est la réactivité que j’aurais voulu voir chez des projets commerciaux », a-t-il écrit.

Les autres nouveautés de la version 2026.2.22

Quelques ajouts discrets mais utiles complètent la mise à jour. L’extension navigateur maintient désormais une connexion persistante au relais local — une friction que les utilisateurs signalaient depuis des mois. Le support de Synology Chat ouvre OpenClaw aux environnements NAS professionnels. Le planificateur cron supporte l’exécution parallèle, avec corrections des déclenchements en double et isolation des tâches défectueuses.

L’auto-updater intégré, désactivé par défaut, propose un mécanisme de déploiement progressif pour le canal stable et des vérifications horaires pour les bêta-testeurs. Un équilibre raisonnable entre stabilité de l’environnement d’inférence et fraîcheur des correctifs de sécurité.

OpenClaw après OpenAI : quel avenir pour le projet ?

OpenClaw a atteint 200 000 étoiles GitHub en 84 jours — un record absolu. Son créateur Peter Steinberger a annoncé mi-février rejoindre OpenAI pour diriger les travaux sur les agents personnels autonomes, en transférant le projet à une fondation open source indépendante qu’OpenAI continuera de financer.

« Ce que je veux, c’est changer le monde, pas bâtir une grande entreprise », écrivait-il dans son billet de blog. On peut trouver ça naïf. Ou lucide. Steinberger avait déjà bâti et revendu plusieurs projets — il sait ce qu’il fait.

La vraie question reste entière : une fondation sous influence d’OpenAI, est-ce encore de l’open source au sens propre ? L’indépendance du pipeline de développement vis-à-vis des intérêts commerciaux d’OpenAI sera le vrai indicateur à surveiller. La confiance de 190 000 contributeurs ne se reconstruit pas facilement une fois perdue.