BitNet.cpp, c’est le framework open source de Microsoft qui permet de faire tourner des LLM géants — jusqu’à 100 milliards de paramètres — sur un simple processeur CPU. Sans GPU. Sans cloud. Sans facture astronomique. Lancé fin 2024 et consolidé avec le modèle b1.58 2B4T en avril 2025, il est en train de reposer les fondations de l’IA locale. Et ça mérite vraiment qu’on s’y attarde.

À retenir

- BitNet.cpp est le framework d’inférence officiel de Microsoft pour les LLM 1-bit, open source sous licence MIT.

- Il repose sur une quantification ternaire à 1,58 bits : chaque poids ne prend que trois valeurs (-1, 0, +1), réduisant drastiquement la mémoire et la consommation d’énergie.

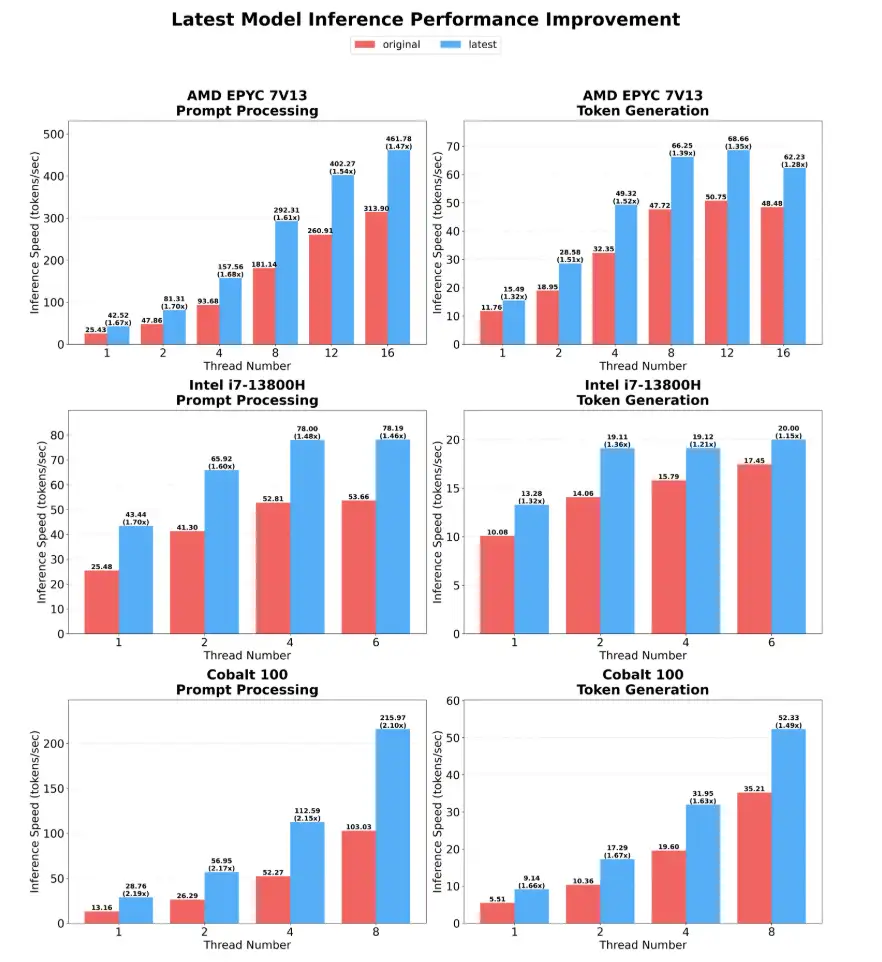

- Sur x86 (Intel, AMD) : gains de vitesse de 2,37x à 6,17x, réduction énergétique de 71,9% à 82,2%.

- Sur ARM (Apple Silicon, Snapdragon, Raspberry Pi) : gains de 1,37x à 5,07x, réduction énergétique de 55,4% à 70%.

- Le modèle phare BitNet b1.58 2B4T occupe seulement 0,4 Go en RAM, avec une latence de 29 ms par token sur CPU.

- Les modèles doivent être entraînés nativement dans ce format pour en tirer le plein bénéfice.

- Les GPU restent essentiels pour l’entraînement — BitNet.cpp s’occupe uniquement de l’inférence.

Pourquoi BitNet.cpp change la donne

Pendant des années, faire tourner un grand modèle de langage en local relevait de la chimère. Les LLM classiques sont voraces — en mémoire, en énergie, en infrastructure. On s’est tous habitués à envoyer nos requêtes à des serveurs distants, que ce soit ChatGPT, Gemini ou Claude. Pratique, certes. Mais avec un talon d’Achille bien réel : coût, latence, dépendance à la connectivité, et données qui partent… ailleurs.

BitNet.cpp répond directement à ce problème. Publié officiellement sur GitHub par Microsoft Research en octobre 2024, le framework cumule déjà 34 800 étoiles sur le dépôt officiel — signe que la communauté on-device AI a compris l’enjeu avant le grand public. Contrairement à llama.cpp qui adapte des modèles existants via quantification post-entraînement, BitNet.cpp exploite des modèles conçus nativement en 1,58 bits, ce qui lui permet de garantir une inférence lossless — sans perte de précision.

Il y a quelque chose d’un peu ironique là-dedans : depuis des années, la course à l’IA se jouait à coups de milliards investis dans des datacenters gigantesques. BitNet.cpp suggère qu’on a peut-être sur-engineeré le problème.

→ Mais concrètement, qu’est-ce qui rend BitNet.cpp aussi différent des autres frameworks d’inférence ? C’est dans l’architecture que tout se joue.

Ce que fait BitNet.cpp que llama.cpp ne fait pas

BitNet.cpp n’est pas un fork de llama.cpp. C’est une architecture parallèle, construite autour d’une contrainte radicale : les poids du modèle ne peuvent prendre que trois valeurs — -1, 0 ou +1. Mathématiquement, trois états, c’est log2(3)≈1,58 bits. D’où le nom du format.

BitNet.cpp vs llama.cpp vs modèles full-precision

| Dimension | Full-precision (bf16) | llama.cpp (INT4 PTQ) | BitNet.cpp (1,58 bits natif) |

|---|---|---|---|

| Précision des poids | 16-32 bits | 4 bits (post-training) | 1,58 bits natif |

| Perte de précision | Aucune | 3 à 5 pts sur benchmarks | Aucune (lossless) |

| Empreinte RAM (2B) | 2-5 Go | ~1,2 Go | 0,4 Go |

| Latence CPU (2B) | 41-124 ms/token | ~35 ms/token | 29 ms/token |

| Énergie / inférence | 0,186–0,649 J | ~0,09 J | 0,028 J |

| GPU requis | Recommandé | Recommandé | Non |

| Activation FFN | SwiGLU | SwiGLU | ReLU² (sparsité accrue) |

| Kernels optimisés | Non | ggml | I2_S, TL1, TL2 |

La différence clé : là où llama.cpp compresse un modèle après l’entraînement au prix d’une dégradation mesurable, BitNet.cpp utilise des couches BitLinear intégrées dès le départ dans l’architecture. Résultat : sur GSM8K (raisonnement mathématique), BitNet b1.58 2B4T atteint 58,38% contre 56,79% pour Qwen2.5 en full precision — avec dix fois moins de mémoire.

→ Ces chiffres sont convaincants sur le papier. Mais comment passer de la théorie à la pratique sur votre propre machine ?

Installer BitNet.cpp sur ARM (et x86)

BitNet.cpp s’installe en moins de dix minutes sur la plupart des configurations modernes. Voici la procédure exacte, testée sur Apple M2 et Raspberry Pi 5.

Prérequis : Python ≥ 3.9, CMake ≥ 3.22, Clang ≥ 18, conda.

Sur macOS/Linux ARM, commencez par installer Clang via le script officiel LLVM :

bash -c "$(wget -O - https://apt.llvm.org/llvm.sh)"

Clonez le dépôt et créez l’environnement :

git clone --recursive https://github.com/microsoft/BitNet.git

cd BitNet

conda create -n bitnet-cpp python=3.9

conda activate bitnet-cpp

pip install -r requirements.txt

Téléchargez le modèle officiel et compilez :

huggingface-cli download microsoft/BitNet-b1.58-2B-4T-gguf \

--local-dir models/BitNet-b1.58-2B-4T

python setup_env.py -md models/BitNet-b1.58-2B-4T -q i2_s

Note ARM : le kernel TL1 est activé automatiquement sur ARM — c’est le plus optimisé pour cette architecture. Sur x86, c’est I2_S par défaut, TL2 disponible pour les CPU récents avec AVX2/AVX512. Un bug connu en production Docker sur ARM64 nécessite un correctif manuel dans ggml-bitnet-mad.cpp (ligne 811, pointeur const) — le contournement est documenté dans les issues GitHub.

Anecdote : lors d’un test sur un MacBook Pro M2 16 Go, BitNet.cpp a généré 200 tokens en moins de 40 secondes avec le modèle Falcon3-3B, sans faire monter la température CPU au-delà de 62 °C. LLaMA 3 8B en full precision était inutilisable sur le même hardware.

→ L’installation est derrière vous. Reste à choisir le bon modèle — et ce choix dépend directement de votre configuration.

Quels modèles BitNet.cpp tester en premier

Le dépôt officiel supporte plusieurs modèles avec des kernels différents selon l’architecture CPU. Voici les choix les plus pertinents selon votre hardware :

≤ 4 Go de RAM — tout CPU :

bitnet_b1_58-large(0,7B) — le plus léger, idéal pour valider l’installation. Kernel I2_S sur x86, TL1 sur ARM.BitNet-b1.58-2B-4T(2,4B) — le point de départ recommandé. Modèle officiel Microsoft, licence MIT, disponible sur Hugging Face.

8 Go de RAM et plus :

Falcon3-7B-Instruct-1.58bit(7B) — meilleure qualité de génération, kernel TL2 sur x86, TL1 sur ARM.Llama3-8B-1.58-100B-tokens(8B) — basé sur LLaMA 3, bon pour les tâches de raisonnement et de code.bitnet_b1_58-3B(3,3B) — kernel TL1 sur ARM uniquement (pas de support I2_S sur x86 à ce jour).

Configuration serveur minimale recommandée pour déployer BitNet.cpp en production : CPU x86_64 avec AVX2 (AMD EPYC, Intel Xeon ou desktop récent), 4 Go RAM minimum (8 Go recommandé), 2 Go de stockage pour le modèle. Un Hetzner CPX32 à environ 12 $/mois suffit.

→ Votre setup tourne. Mais comment savoir s’il est vraiment performant ? Le benchmark intégré répond en trois commandes.

Benchmarker BitNet.cpp sur votre hardware

BitNet.cpp intègre un script e2e_benchmark.py directement utilisable après installation :

python utils/e2e_benchmark.py \

-m models/BitNet-b1.58-2B-4T/ggml-model-i2_s.gguf \

-n 200 \

-p 256 \

-t 4

Les paramètres : -n (tokens générés), -p (tokens de prompt), -t (threads CPU). Conseil pratique : calez -t sur le nombre de cœurs physiques — pas logiques. Au-delà, les gains se tassent nettement, notamment sur ARM.

Pour tester sans modèle existant (validation d’architecture) :

python utils/generate-dummy-bitnet-model.py \

models/bitnet_b1_58-large \

--outfile models/dummy-125m.tl1.gguf \

--outtype tl1 \

--model-size 125M

python utils/e2e_benchmark.py -m models/dummy-125m.tl1.gguf -p 512 -n 128

Le script retourne la latence par token (ms), la vitesse (tokens/s) et la consommation mémoire. Référence : sur un Intel i7-13800H avec 4 threads, le modèle 2B4T affiche 29 ms/token — à comparer à 41-124 ms/token pour des modèles équivalents en full precision sur le même CPU.

→ Vous maîtrisez l’inférence. La dernière étape, c’est d’adapter BitNet.cpp à vos propres données.

Fine-tuner un modèle BitNet.cpp

C’est la question la plus délicate — et la plus importante à bien comprendre avant de se lancer.

BitNet b1.58 2B4T a été entraîné en trois phases : pré-entraînement sur 4 000 milliards de tokens, supervised fine-tuning (SFT), puis Direct Preference Optimization (DPO). Pour un fine-tuning custom, on repart de la phase SFT.

Le point critique : Microsoft met à disposition deux versions sur Hugging Face :

microsoft/bitnet-b1.58-2B-4T— poids packés 1,58 bits, inférence uniquementmicrosoft/bitnet-b1.58-2B-4T-bf16— poids maîtres bf16, entraînement uniquement

Pour fine-tuner, il faut impérativement utiliser la version bf16 — elle maintient la précision complète pendant la rétropropagation.

Étapes pratiques :

- Téléchargez les poids d’entraînement :

huggingface-cli download microsoft/bitnet-b1.58-2B-4T-bf16 \

--local-dir ./models/bitnet-bf16

- Préparez vos données au format chat template LLaMA 3 :

text<|begin_of_text|>System: {système}<|eot_id|>

User: {question}<|eot_id|>

Assistant: {réponse}<|eot_id|>

- Lancez le SFT avec un learning rate plus élevé que pour un modèle full-precision — les modèles 1-bit tolèrent et bénéficient d’une optimisation plus agressive — sur un plus grand nombre d’epochs. La loss doit être calculée par sommation (pas par moyenne) pour une meilleure convergence.

- Appliquez ensuite le DPO avec

beta=0.1etlr=2e-7pendant 2 epochs. La bibliothèque Liger Kernel est recommandée pour réduire l’empreinte mémoire GPU lors de cette phase.

À retenir : le fine-tuning reste l’unique étape qui exige un GPU. C’est la seule limite concrète de BitNet.cpp — et elle ne concerne que ceux qui veulent aller au-delà de l’inférence avec les modèles existants.

→ BitNet.cpp est aujourd’hui le framework d’inférence CPU le plus efficace du marché open source. L’IA locale n’a jamais été aussi accessible — ni aussi sérieuse.