Un modèle open-weight chinois, gratuit, qui dépasse GPT-5.4 sur les benchmarks agentiques les plus exigeants du moment. Si ça ne vous choque pas un peu, c’est que vous avez déjà accepté quelque chose que beaucoup de gens dans l’industrie refusent encore d’admettre.

À retenir

K2.6 domine sur les tâches agentiques et l’usage outillé — les vrais cas d’usage de 2026 — tout en restant accessible gratuitement via HuggingFace ou déployable en local avec Unsloth. L’écart avec GPT-5.4 sur les maths pures est réel mais marginal pour la plupart des workflows. La vraie proposition de valeur n’est pas “mieux que les Américains” mais “aussi bien, open-weight, et déployable chez vous sans dépendance à une API propriétaire”.

Et si la vraie menace pour les éditeurs de modèles propriétaires n’était pas Kimi K2.6 lui-même — mais le moment où vous réaliserez que vous n’avez plus besoin de leur permission pour déployer de l’intelligence de pointe ?

La hiérarchie qu’on n’attendait pas

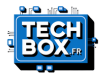

Kimi K2.6, sorti le 20 avril 2026 par Moonshot AI, vient d’être classé modèle open-weight #1 par Artificial Analysis. Pas #4, pas “prometteur” — numéro un, devant tous les autres poids ouverts. Et ses résultats sur les benchmarks que personne ne peut ignorer :

| Benchmark | Kimi K2.6 | GPT-5.4 | Claude Opus 4.6 | Gemini 3.1 Pro |

|---|---|---|---|---|

| SWE-Bench Verified | 80,2% | — | 80,8% | 80,6% |

| SWE-Bench Pro | 58,6% | 57,7% | 53,4% | 54,2% |

| HLE-Full (tools) | 54,0% | 52,1% | 53,0% | 51,4% |

| DeepSearchQA f1 | 92,5% | 78,6% | 91,3% | 81,9% |

| BrowseComp | 83,2% | 82,7% | 83,7% | 85,9% |

| BrowseComp (Swarm) | 86,3% | 78,4% | — | — |

| AIME 2026 | 96,4% | 99,2% | 96,7% | 98,3% |

| GPQA-Diamond | 90,5% | 92,8% | 91,3% | 94,3% |

| Terminal-Bench 2.0 | 66,7% | 65,4% | 65,4% | 68,5% |

Ce que ces chiffres disent vraiment : K2.6 domine sur tout ce qui touche aux tâches agentiques et à l’usage outillé — exactement les cas où vous attendez qu’un modèle travaille pour vous plutôt que de répondre à vos questions. GPT-5.4 garde l’avantage sur les mathématiques pures avec 99,2% sur AIME 2026 contre 96,4% — un écart de moins de 3 points, négligeable pour 99% des workflows réels.

Vous pensez encore qu’un modèle américain propriétaire vaut automatiquement mieux parce qu’il est propriétaire ? C’est exactement le biais que Moonshot a parié contre.

L’architecture qui fait la vraie différence opérationnelle

K2.6 utilise une architecture Mixture-of-Experts à 1 trillion de paramètres avec 32 milliards activés par token et une fenêtre de contexte de 256 000 tokens. Ce qui change vraiment par rapport à K2.5, c’est l’Essaim d’agents : jusqu’à 300 sous-agents en parallèle, 4 000 étapes coordonnées, et les “Claw Groups” — un espace collaboratif où agents et humains co-pilotent des workflows complexes.

Le modèle s’intègre nativement avec OpenClaw, Cursor et les grands frameworks d’agents. Timing parfait : Anthropic a récemment restreint l’accès tiers à Claude dans les pipelines agentiques, laissant un vide que K2.6 remplit sans friction.

Deux erreurs, deux leçons que je ne referai pas

La première : il y a dix-huit mois, j’ai intégré un modèle open-weight chinois dans le pipeline d’un client e-commerce pour automatiser la revue de code. Les performances étaient là. Le COMEX a rejeté le projet en deux réunions, pas sur des critères techniques, mais sur un argument de confiance géopolitique — “on ne peut pas mettre nos données là-dedans”. Le modèle était excellent. Le contrat est tombé. Leçon brutale : les benchmarks ne font pas le choix d’adoption en entreprise. La gouvernance des données et la capacité à déployer localement pèsent souvent plus lourd que le score sur SWE-Bench.

La deuxième erreur, plus récente. En janvier 2026, j’ai conseillé à une équipe DevOps de rester sur Claude pour leurs agents d’infrastructure, arguant que la “maturité de l’écosystème” primait. Trois mois plus tard, Anthropic restreignait justement les accès tiers dans les pipelines agentiques — le cas d’usage exact de mon client. Ils ont dû migrer en urgence. K2.6 aurait été le choix évident dès le départ, avec son intégration native OpenClaw et ses poids déployables en local. Ce jour-là, j’ai appris à ne plus confondre “leader du marché” avec “meilleur choix pour votre contexter.

Où récupérer le modèle et comment l’utiliser

Trois chemins selon votre profil :

Le plus simple, pour tester sans rien installer : l’interface web officielle kimi.com, ou l’app mobile sur iOS et Android.

Pour un usage API dans vos applications, la plateforme platform.kimi.ai expose une API 100% compatible OpenAI — remplacez base_url par https://api.moonshot.ai/v1 et utilisez model="kimi-k2.6" :

pip install --upgrade 'openai>=1.0'Pour un déploiement entièrement local, Unsloth propose les poids quantifiés sur HuggingFace :

hf download unsloth/Kimi-K2.6-GGUF \

--local-dir unsloth/Kimi-K2.6-GGUF \

--include "*UD-Q2_K_XL*" # version allégée

# ou "*UD-Q8_K_XL*" pour la pleine précisionLancez ensuite Unsloth Studio en local via http://localhost:8888. Ollama supporte également K2.6 nativement pour ceux qui préfèrent une interface plus simple.

Le contexte géopolitique qu’on préfère éviter

Moonshot AI est valorisée à 18 milliards de dollars, avec Alibaba et HongShan à son capital. En février 2026, Anthropic les a accusés d’utiliser des comptes frauduleux pour extraire des données d’entraînement de Claude. Les résultats officiels complets des benchmarks ne sont pas encore finalisés — Moonshot les annonce pour début mai.

Est-ce que cette controverse disqualifie le modèle ? Non. Mais elle pose une question que personne ne pose assez fort : si les données d’entraînement des modèles “open” restent opaques, qu’est-ce qui les distingue vraiment des modèles propriétaires sur le plan de la confiance ?