Google vient de nommer son prochain agent IA “Remy”. Comme le rat de Ratatouille, il cuisine à votre place sans que vous voyiez ses pattes. Et si le problème n’était pas qu’il soit mauvais mais qu’il soit trop efficace pour être vraiment neutre ?

Hier encore, les assistants vocaux promettaient de “changer votre vie”. Siri existe depuis 2011. On lui demande encore d’allumer la minuterie.

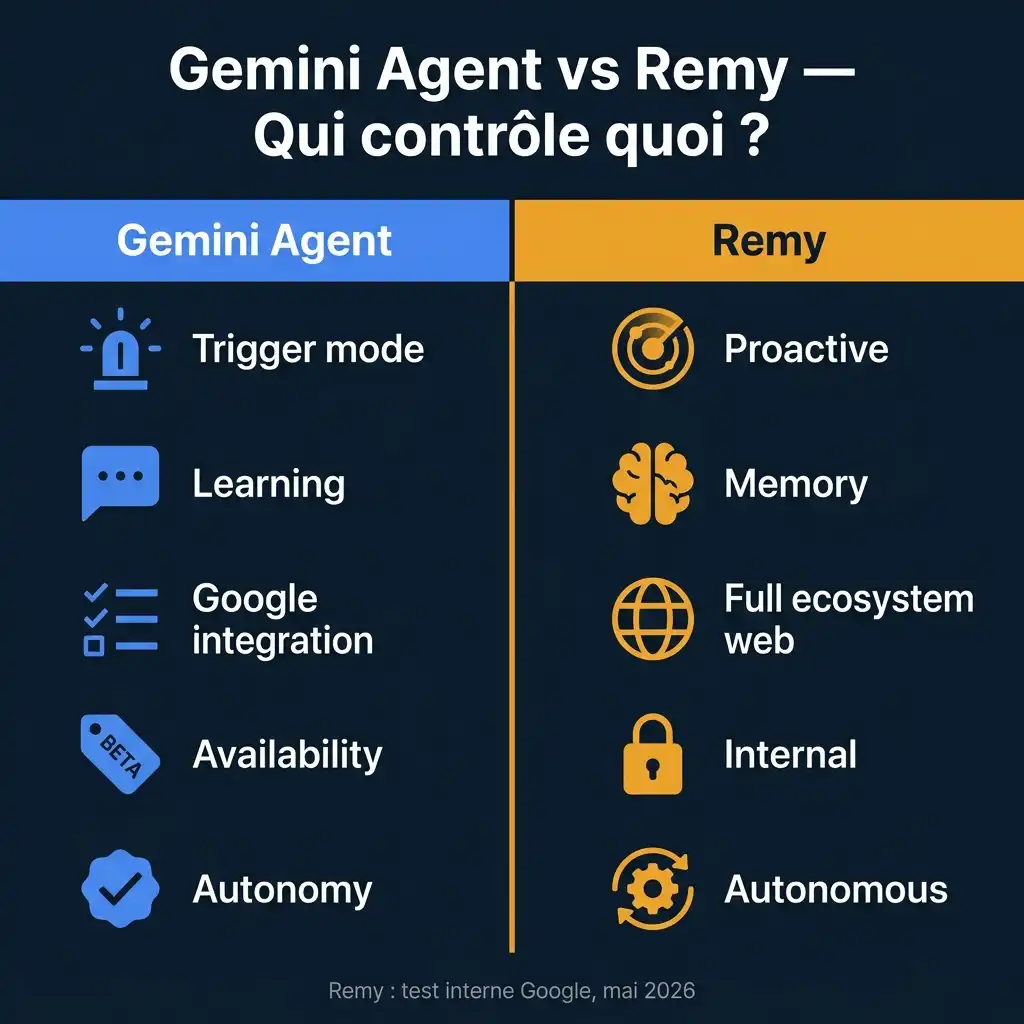

Remy est autre chose. Ce n’est pas un assistant qui attend qu’on lui parle. D’après les documents internes vus par Business Insider, c’est un agent qui “surveille ce qui compte pour vous, gère des tâches complexes de manière proactive et apprend vos préférences dans le temps”. Cette nuance est énorme et elle change tout : un assistant répond, un agent décide. Personne dans la presse tech grand public ne l’a encore vraiment formulé comme ça.

À retenir

Remy n’est pas une mise à jour cosmétique de Gemini. C’est la tentative de Google de transformer un assistant en système nerveux central de votre existence numérique, là où OpenClaw a démontré qu’un développeur seul dans une chambre d’hôtel peut aller plus vite qu’un géant — tout en exposant 40 000 instances vulnérables sur internet en moins de six semaines. La fracture à surveiller n’est pas entre les LLMs. Elle est entre deux philosophies de contrôle radicalement opposées : agent propriétaire intégré à un écosystème publicitaire, ou agent autonome hébergé chez vous, avec des risques de sécurité que vous devrez gérer vous-même.

Ce qui ne me quitte pas depuis que Brin a parlé d'”axe majeur” : les agents qui réussiront vraiment ne seront pas les plus puissants. Ils seront ceux en qui les utilisateurs auront encore envie de faire confiance dans six mois. Et la confiance, ça ne se déploie pas en dogfooding.

Ce que les cobayes internes testent en ce moment

Le projet est en phase de dogfooding — cette pratique où les employés Google servent de cobayes avant tout lancement public. Remy tourne dans une version réservée au staff de l’application Gemini, intégré à travers les services Google. Aucune date de sortie annoncée. Mais chez Google, quand quelque chose arrive à ce stade, le “si” disparaît. Il reste le “quand”.

Ce qui renforce cette intuition, c’est le précédent Agent Smith : un outil de codage autonome déployé en interne en mars, devenu si populaire que l’accès a dû être restreint. Quand un prototype interne déborde au point de provoquer une pénurie d’accès, vous n’êtes plus dans l’expérimentation. Vous êtes dans la validation de marché la plus honnête qui soit — celle que personne n’a commandée.

Pourquoi “Remy” et pas juste Gemini Agent

Voilà la question que personne ne pose vraiment. Gemini a déjà une fonctionnalité expérimentale capable de naviguer sur le web, gérer Gmail et Google Agenda. Alors pourquoi créer un nom, un personnage, presque une mascotte ?

Parce qu’OpenClaw a changé les règles du jeu — et que Google le sait. Né dans une chambre d’hôtel selon la légende du projet, cet agent open-source développé par Peter Steinberger tourne sur votre propre matériel, répond sur WhatsApp, se réveille toutes les 30 minutes pour checker vos emails sans que vous lui demandiez quoi que ce soit. Plus de 280 000 étoiles GitHub en quelques semaines. Face à ça, Google ne peut pas juste “intégrer”. Google doit incarner. Remy est une marque, une promesse narrative. Pas juste une API de plus dans un dashboard.

Mais voilà quelque chose qui va à contre-courant de tout ce que vous lisez en ce moment : OpenClaw n’est pas la panacée qu’on vous vend. En janvier 2026, l’opération ClawHavoc a vu 341 skills malveillants distribués via ClawHub, le marketplace communautaire — soit environ 12% de l’ensemble du registre compromis en une seule vague. Des keyloggers sur Windows, l’Atomic Stealer sur macOS, tout emballé dans des noms d’outils innocents. Et en février, 40 214 instances OpenClaw exposées sur internet, dont 35,4% jugées vulnérables au moment de l’analyse.

Un agent autonome avec accès à vos messages, vos fichiers, vos emails et vos tokens OAuth — construit sur des plugins communautaires non vérifiés — c’est une surface d’attaque que peu de tutoriels enthousiastes mentionnent. La liberté a un prix. Ce prix, il s’appelle CVE-2026-25253, CVE-2026-24763, et cinq autres du même acabit.

L’erreur que j’ai payée cash

Il y a un an, un client dans le secteur des services financiers m’a demandé de déployer Gemini for Workspace pour son équipe support. L’argument était simple : réduire le temps de traitement des emails entrants grâce aux suggestions de réponses contextuelles et aux résumés automatiques de fils de conversation. On a configuré, testé, validé en environnement contrôlé. Tout fonctionnait. On a déployé.

Trois mois plus tard, il me rappelle. Pas furieux — glacial, ce qui est pire.

Gemini avait appris le style de communication de l’équipe — conciliant, rapide, orienté résolution. Ce que personne n’avait anticipé : plusieurs clients en litige actif avec l’entreprise continuaient à écrire au support, et les suggestions de Gemini proposaient des formulations empathiques et accommodantes que les conseillers validaient sans toujours relire. Des phrases interprétables comme des reconnaissances implicites de responsabilité. Le service juridique a déchanté en découvrant les archives.

La leçon brutale ? Un agent qui “apprend votre style” ne comprend pas le contexte dans lequel ce style devient dangereux. Il optimise pour ce qu’il observe — pas pour ce que vous devriez faire dans des cas limites qu’il n’a jamais vu venir.

Remy reproduit exactement cette architecture de confiance implicite, à une échelle et une profondeur d’intégration bien supérieures. Et Google a laissé entendre que des publicités pourraient apparaître dans Gemini à mesure que la plateforme se développe. Posez-vous sérieusement cette question : faites-vous vraiment confiance à un agent “personnel” financé par la régie publicitaire la plus puissante du monde pour gérer vos tâches sans conflit d’intérêt ? L’agent apprend qui vous êtes. La régie sait ce qu’il sait. Ce n’est pas de la paranoïa — c’est du business model documenté.

Ce que Sundar Pichai ne dit pas à voix haute

75% du nouveau code Google est désormais généré par l’IA. La Gemini Enterprise Agent Platform lancée à Google Cloud Next ’26 en avril unifie développement, gouvernance et exploitation en une seule pile. Microsoft fait pareil avec Copilot 365. OpenAI pousse dans la même direction.

Sauf que cette convergence cache une asymétrie radicale que personne ne veut formuler clairement. Google construit simultanément l’infrastructure entreprise avec Gemini Enterprise Agent Platform, l’outil développeur avec Agent Smith et Vertex AI, et l’agent grand public avec Remy. Trois couches. Une seule ambition. Et le modèle économique qui les traverse n’est pas l’abonnement — c’est la donnée comportementale générée quand un agent gère votre vie à votre place, 24h/24, dans chaque service que vous utilisez déjà. Microsoft construit la même pile. OpenAI aussi. Mais aucun des deux n’a la profondeur d’intégration historique dans votre quotidien numérique que Google possède depuis vingt ans.

Le vrai match de 2026 n’est pas “qui a le meilleur LLM”. C’est “qui contrôle la couche agentique de votre vie numérique quotidienne”. Et la réponse à cette question déterminera qui vous êtes en ligne dans dix ans.

Ce que vous vous demandez probablement

Remy est-il déjà disponible au grand public ?

Non. Au moment où cet article est écrit, Remy est exclusivement en phase de tests internes chez Google. Aucune date de lancement public n’a été communiquée, et un porte-parole de Google a refusé de commenter.

Quelle est la vraie différence entre Remy et un simple chatbot Gemini ?

La différence est architecturale, pas cosmétique. Un chatbot attend une question et répond. Remy est conçu pour surveiller, anticiper et agir de manière autonome à travers tous vos services Google (Gmail, Agenda, Drive) sans que vous lui demandiez explicitement à chaque fois. C’est le passage du mode réactif au mode proactif, et ce saut-là n’est pas anodin.

OpenClaw est-il vraiment dangereux ou juste mal configuré ?

Les deux, honnêtement. Les CVEs documentés en 2026 — dont CVE-2026-24763 permettant l’exécution de commandes à distance — ne sont pas des erreurs de configuration utilisateur, ce sont des failles dans le produit lui-même. Un déploiement correctement isolé, sans plugins communautaires non vérifiés, réduit drastiquement la surface d’attaque. Le problème c’est que 95% des utilisateurs ne font pas ça.

Peut-on faire confiance à Remy avec des données sensibles professionnelles ? Pas encore, et peut-être jamais sans garde-fous explicites. Google n’a pas encore détaillé son cadre de gouvernance des données pour Remy. La Gemini Enterprise Agent Platform prévoit des mécanismes de gouvernance pour les entreprises, mais ce n’est pas la même chose que l’agent grand public que sera Remy. La règle de prudence élémentaire : ne laissez jamais un agent proactif accéder à des données dont la compromission vous coûterait plus cher que le gain de productivité promis.