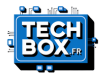

AMD frappe un grand coup avec le Ryzen AI Max+ 395, un processeur qui transforme votre PC en véritable centrale d’intelligence artificielle. Capable de faire tourner des modèles LLM jusqu’à 128 milliards de paramètres en local, il ouvre des perspectives inédites pour les développeurs, les passionnés de tech et les créateurs de contenu.

Une puissance IA sans précédent

Ce processeur n’est pas juste rapide — il est conçu pour l’IA :

+ Jusqu’à 128 milliards de paramètres pris en charge

+ 15 tokens/seconde pour des modèles comme Llama 4 Scout

+ 96 Go de VRAM dynamique grâce à la technologie Variable Graphics Memory

+ Bande passante mémoire de 211 Go/s, idéale pour les contextes étendus

En clair : plus besoin de GPU dédié ni de cloud pour exécuter des modèles massifs. Tout se passe sur votre machine, en toute autonomie.

Quels modèles LLM tournent sur Ryzen AI Max+ 395 ?

Voici les modèles testés et validés :

| Modèle | Paramètres | Type | Avantage clé |

|---|---|---|---|

| Llama 4 Scout | 109B (17B actifs) | MoE (Mixture-of-Experts) | Contexte étendu, rapidité d’inférence |

| Mistral Large | 123B | Dense | Haute précision, quantification Q4 K M |

| Gemma 3 | ~20B | Dense | Faible empreinte mémoire |

| Qwen3 | ~20B | Dense | Optimisé pour Q6/Q8 |

| Llama 2 | 7B à 70B | Dense | Support complet via llama.cpp |

| Llama 3 | 7B à 70B | Dense | Support complet via llama.cpp |

Technologies embarquées

Le Ryzen AI Max+ 395 intègre des outils de pointe :

Support Vulkan + llama.cpp : accélération via Flash Attention et KV Cache

Contexte jusqu’à 256 000 tokens : idéal pour les résumés longs ou les dialogues complexes

MCP (Model Context Protocol) : permet aux modèles de piloter des apps locales ou d’interagir avec des API

Cas d’usage concrets

Assistants vocaux privés et sécurisés

Résumés de documents confidentiels

Automatisation de tâches locales

Développement de modèles personnalisés

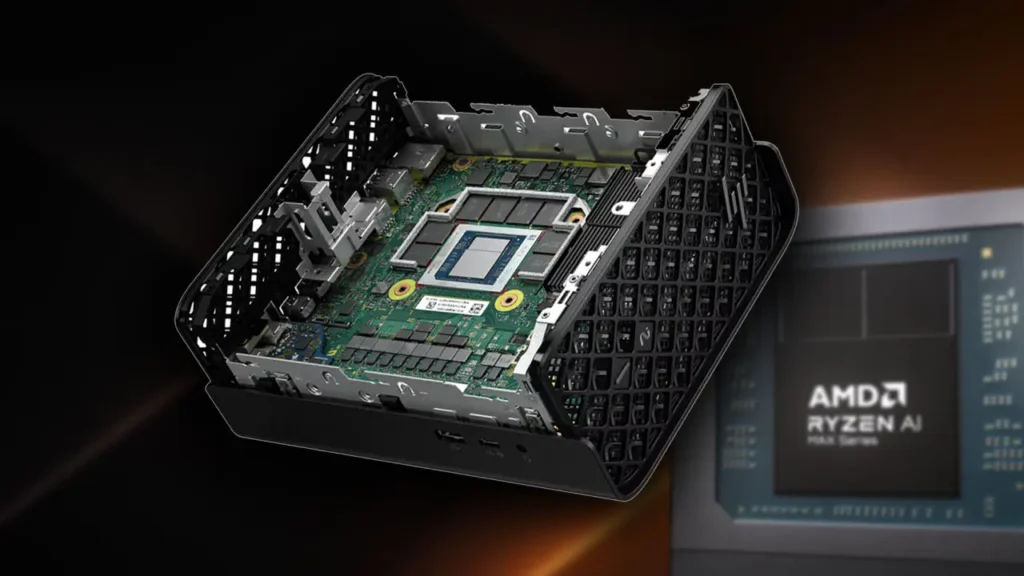

Intégrations OEM du Ryzen AI Max+ 395

Le Ryzen AI Max+ 395, basé sur l’architecture Zen 5 et doté d’un NPU XDNA 2, commence à équiper plusieurs machines orientées inférence locale et workloads IA intensifs.

Les premiers systèmes disponibles sont :

| Constructeur | Modèle | Format | Usage cible |

|---|---|---|---|

| ASUS | ROG Flow Z13 | Hybride 2-en-1 | IA mobile / gaming |

| HP | ZBook Ultra G1a | Station mobile | Création / IA embarquée |

| HP | Z2 Mini G1a | Mini PC | Edge computing / IA locale |

| Corsair | AI Workstation 300 | Desktop compact | Développement LLM / inference |

| Framework | Framework Desktop | Modulaire | Personnalisation / open hardware |

| Beelink | GTR9 Pro AMD Ryzen AI Max+ 395 | Mini PC | Edge computing / IA locale |

Pourquoi c’est une révolution ?

Le Ryzen AI Max+ 395 démocratise l’accès à l’intelligence artificielle avancée. Il permet à chacun — développeur, chercheur ou créateur — de travailler avec des modèles puissants, sans dépendre du cloud ni investir dans du matériel coûteux.

FAQ

Quels modèles LLM sont compatibles avec Ryzen AI Max+ 395 ?

Le Ryzen AI Max+ 395 peut exécuter localement des modèles LLM allant jusqu’à 128 milliards de paramètres. Parmi les modèles compatibles et testés :

Llama 4 Scout (MoE, 109B avec 17B actifs)

Mistral Large (123B, dense)

Gemma 3 (~20B, dense)

Qwen3 (~20B, dense)

Llama 2 & 3 (7B à 70B)

Ces modèles fonctionnent grâce à la prise en charge de llama.cpp, Vulkan, et jusqu’à 96 Go de VRAM dynamique.

Peut-on exécuter des modèles IA sans carte graphique ?

Oui. Grâce à l’architecture du Ryzen AI Max+ 395 et à sa mémoire LPDDR5X, il est possible d’exécuter des modèles LLM massifs sans GPU dédié. La technologie Variable Graphics Memory permet d’allouer jusqu’à 96 Go de VRAM à l’inférence IA, directement depuis la RAM système.

Quelle est la différence entre MoE et Dense ?

Dense : Tous les paramètres du modèle sont activés à chaque requête. Cela garantit une cohérence maximale mais consomme plus de ressources.

MoE (Mixture-of-Experts) : Seuls certains “experts” sont activés selon le contexte. Cela permet de réduire la charge tout en conservant des performances élevées. Exemple : Llama 4 Scout n’active que 17B sur 109B à chaque requête.

Liens

- Vers llama.cpp

- Vers AMD Ryzen AI