Tu paies Claude ou ChatGPT chaque mois. Tu subis les limites d’usage. Tu envoies tes prompts dans un cloud que tu ne contrôles pas. Et si tout ça était devenu optionnel le 3 avril 2026 ? Google vient de sortir un modèle IA open source qui écrase des géants 20 fois plus gros — installable en trois commandes, gratuit pour toujours, qui tourne entièrement sur ta machine.

À retenir avant de fermer cet onglet

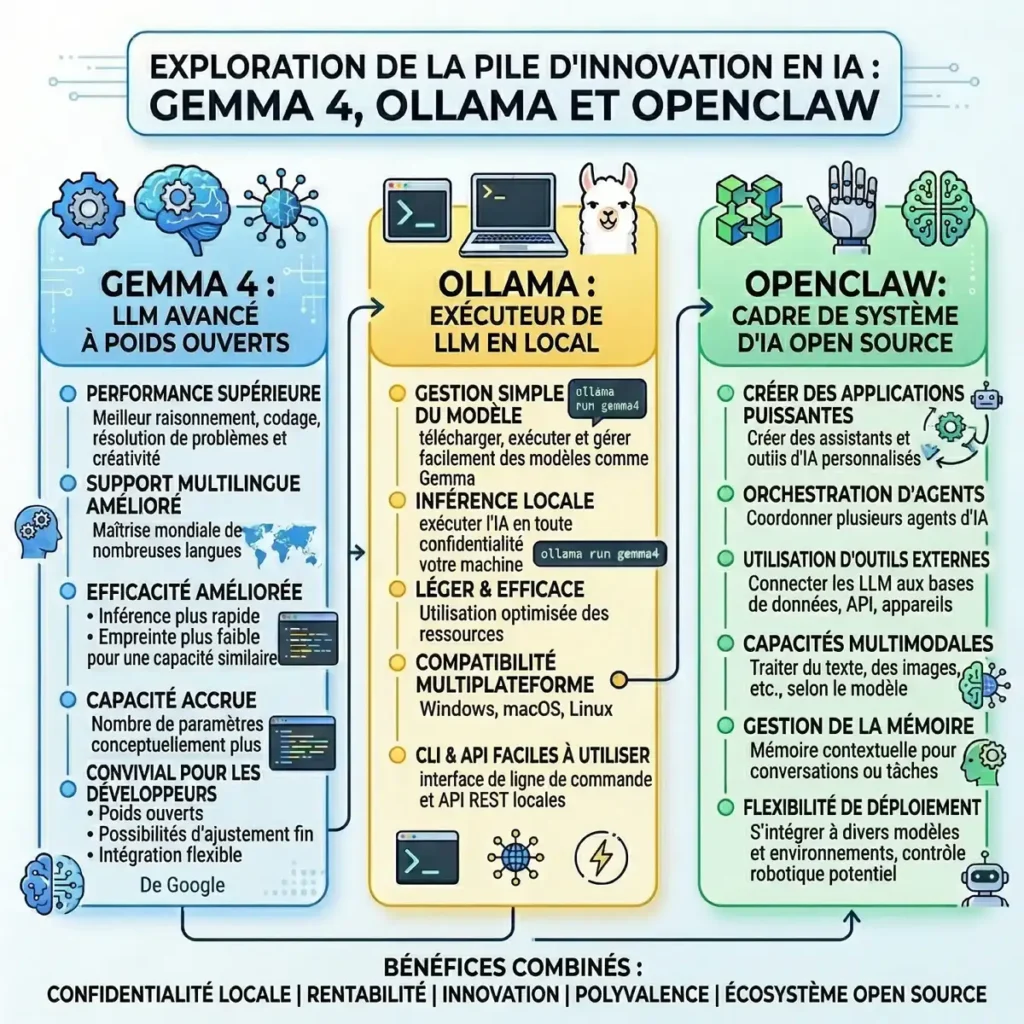

La combinaison Gemma 4 + Ollama + OpenClaw couvre trois besoins distincts avec zéro coût récurrent : un modèle IA open source de niveau mondial, une couche d’exécution locale propre, et une interface agent pilotable depuis n’importe quelle messagerie. Ce n’est pas un bricolage de passionné, c’est un stack production-ready sous Apache 2.0, utilisé par une communauté de plusieurs millions de développeurs.

Ce que personne ne veut vraiment admettre

La vraie raison pour laquelle les développeurs évitent les modèles IA locaux, ce n’est pas le matériel. C’est la peur que ça soit “moins bon”. Cette excuse vient de mourir.

Gemma 4 est la dernière famille de modèles open source de Google DeepMind, bâtie sur la même base de recherche que Gemini 3, le flagship commercial de Google. Entièrement gratuit, téléchargeable sans compte, utilisable en production commerciale sous licence Apache 2.0. Zéro royalties, zéro zone grise légale. Le genre d’information que l’industrie du SaaS préfère ne pas trop amplifier.

Les benchmarks qui font grimacer les éditeurs payants

Le 31B atteint 89,2% sur AIME 2026 contre 20,8% pour Gemma 3 sur ce même test de raisonnement mathématique. Sur LiveCodeBench v6, qui mesure la qualité réelle du code généré, le bond est de 29,1% à 80,0%. Au classement Arena AI des meilleurs modèles open source dans le monde, Gemma 4 se positionne troisième le jour de sa sortie, en battant des modèles avec vingt fois plus de paramètres.

Quatre tailles disponibles, quatre cas d’usage distincts. Les versions E2B et E4B sont conçues pour les laptops et smartphones, avec une fenêtre de contexte de 128 000 tokens et support natif du texte, de l’image et de l’audio. Les versions 26B et 31B ciblent les workstations, avec 256 000 tokens de contexte. Toutes supportent le function calling natif — condition sine qua non pour les usages agentiques sérieux.

Le 26B est architecturalement malin. Il affiche 26 milliards de paramètres totaux mais n’en active que 3,8 milliards par token lors de l’inférence grâce à une architecture Mixture of Experts. Tu obtiens un niveau de raisonnement proche du 26B dense pour une fraction du coût GPU. C’est précisément ce qui le rend utilisable sur du matériel grand public sans saigner ta carte de crédit.

La journée où j’ai tout fait rater

Il faut que je te raconte un truc. Il y a deux ans, j’ai passé une journée entière à monter un setup IA local qui ne fonctionnait jamais vraiment. Mauvaise version d’Ollama, modèle trop lourd pour ma RAM, tool calls qui plantaient silencieusement sans message d’erreur. Le genre d’après-midi qui te convainc de repayer un abonnement et de passer à autre chose.

La leçon brutale que j’en ai tirée : les installations de modèles locaux ratent presque toujours au même endroit — le choix de la taille du modèle, pas l’outil. J’aurais dû commencer par l’E4B. Il tourne sur seulement 5 Go de RAM en quantification 4-bit. Le 26B quantisé réclame environ 18 Go. Vérifie tes specs avant de lancer ollama pull. C’est le conseil que personne ne donne assez tôt.

Installer Gemma 4 en local avec Ollama : le setup complet

Ollama est la couche d’exécution. Tu télécharges l’application sur ollama.com, puis tu lances dans ton terminal :

ollama pull gemma4 — récupère la version E4B par défaut, environ 3,3 Go, le bon point de départ pour la majorité des machines.

Pour la version 26B MoE si tu as 16 à 24 Go de VRAM : ollama pull gemma4:26b. Pour le 31B dense : ollama pull gemma4:31b. Ollama expose ensuite une API REST locale au port 11434, compatible Python et JavaScript — ce qui rend ce modèle IA gratuit directement embarquable dans tes propres apps. Les développeurs Gemma ont déjà cumulé plus de 400 millions de téléchargements et 100 000 variantes communautaires depuis la première version. La version 4 est la plus capable de toutes.

Transformer Gemma 4 en agent IA personnel avec OpenClaw

C’est là où ça devient vraiment intéressant. Ollama fait tourner le modèle. OpenClaw le transforme en assistant IA personnel open source que tu peux piloter depuis ton téléphone.

OpenClaw est un daemon qui tourne en arrière-plan sur ta machine — Mac, Windows ou Linux — et qui se connecte aux messageries que tu utilises déjà : Telegram, Slack, Discord, WhatsApp, iMessage. Tu lui envoies un message comme à un collègue. Il répond, exécute des commandes shell, lit et écrit des fichiers, contrôle un navigateur Chromium dédié.

La configuration OpenClaw avec Ollama prend cinq minutes. Tu installes depuis openclaw.ai, tu sélectionnes Ollama comme provider dans le wizard d’onboarding, tu entres l’URL locale http://127.0.0.1:11434, et tu connectes Telegram via un bot token. C’est la voie la plus rapide pour un premier setup. Une fois lancé, tu as un agent IA local qui n’envoie rien dans le cloud, ne génère aucune facture, et répond depuis n’importe quel appareil.

Une nuance honnête à garder en tête : le chat, la génération de code et l’analyse de fichiers fonctionnent parfaitement avec Ollama en local. L’exécution agentique avancée — contrôle de navigateur en temps réel, workflows multi-étapes complexes — reste plus stable avec un modèle cloud en backend, lié aux contraintes du protocole de streaming local. Pour 90% des cas d’usage quotidiens, ça ne change rien.

Ce que Gemma 4 produit vraiment : test en conditions réelles

Les benchmarks, c’est bien. Voir ce que ça donne sur un cas concret, c’est mieux.

Une seule invite : générer un calculateur SEO fonctionnel en HTML qui analyse la densité de mots-clés, le nombre de mots et une estimation de lisibilité. Résultat : un fichier complet, structure HTML, CSS et JavaScript, opérationnel à l’ouverture dans le navigateur, sans débogage. Le bond de Codeforces Elo de 110 à 2150 entre Gemma 3 et Gemma 4 ne se lit pas que sur un graphique — il se ressent dans la fiabilité de ce que le modèle produit en une passe.

Et tout ça s’est passé en local. Sans connexion internet. Sans appel API. Sans ligne de facture à la fin du mois.

Trois réglages que la plupart des guides oublient de mentionner

Gemma 4 a un mode de raisonnement configurable à la volée. Tu n’as pas besoin de changer de paramètres système : tu demandes simplement au modèle de “réfléchir étape par étape” pour les tâches complexes, ou tu formulles directement pour les réponses rapides. La différence de latence est significative — apprends à switcher selon le contexte.

Le support multimodal est natif sur toutes les tailles. Image en entrée sur les quatre modèles, audio supplémentaire sur les E2B et E4B. Si tu travailles sur des workflows d’analyse d’images ou de transcription, c’est disponible sans configuration additionnelle via l’API REST Ollama.

Apache 2.0, ça veut dire quelque chose de très concret : tu peux construire un produit commercial par-dessus Gemma 4 sans demander la permission à Google, sans payer de royalties, et sans craindre un changement de conditions tarifaires dans six mois. C’est le modèle de licence que les développeurs sérieux cherchent, et c’est exactement ce que Google a choisi pour cette version.

La vraie question n’est pas “est-ce que ce modèle IA gratuit est assez bon pour moi”. La vraie question, c’est : dans combien de temps les outils payants vont devoir justifier leur existence face à ça ?

FAQ : Gemma 4, Ollama & OpenClaw

Gemma 4 est-il vraiment gratuit pour un usage commercial ?

Oui, sans restriction. Gemma 4 est publié sous licence Apache 2.0, ce qui signifie que tu peux l’intégrer dans un produit commercial, le redistribuer ou le modifier sans payer de royalties ni demander d’autorisation à Google. C’est un point fondamental qui le distingue de nombreux modèles “open source” aux licences restrictives.

Quelle taille de modèle choisir selon ma machine ?

L’E4B est le bon point d’entrée : il tourne sur 5 Go de RAM minimum en quantification 4-bit et couvre la grande majorité des usages quotidiens. Si tu disposes de 16 à 24 Go de VRAM, le 26B MoE offre un niveau de raisonnement nettement supérieur pour un coût compute raisonnable. Le 31B dense est réservé aux workstations avec au moins 32 Go de mémoire GPU.

Faut-il une connexion internet pour utiliser Gemma 4 avec Ollama ?

Uniquement pour le téléchargement initial du modèle. Une fois le fichier en local, tout fonctionne hors ligne — inférence, API REST, appels depuis OpenClaw inclus. Aucune donnée ne quitte ta machine.

OpenClaw fonctionne-t-il sur Windows, pas seulement sur Mac ?

Oui. OpenClaw tourne sur Mac, Windows et Linux. La configuration Ollama est identique sur les trois systèmes — tu pointes simplement sur l’URL locale http://127.0.0.1:11434 lors du wizard d’installation.

Gemma 4 gère-t-il les images et l’audio en local via Ollama ?

Le support multimodal image est natif sur les quatre tailles de modèle. L’audio est disponible uniquement sur les versions E2B et E4B. Ces capacités sont accessibles directement via l’API REST Ollama au port 11434, sans configuration additionnelle.

Quelle est la différence entre le 26B MoE et le 31B dense ?

Le 26B Mixture of Experts affiche 26 milliards de paramètres totaux mais n’en active que 3,8 milliards par token lors de l’inférence. Il est donc beaucoup moins gourmand en mémoire et en calcul que le 31B dense, tout en offrant un niveau de raisonnement proche. Pour la plupart des cas d’usage sur workstation, le 26B MoE est le meilleur compromis performance/ressources.

OpenClaw peut-il exécuter des tâches automatiquement, pas juste répondre au chat ?

Oui — lecture et écriture de fichiers, exécution de commandes shell, contrôle d’un navigateur Chromium dédié. Nuance importante : ces fonctions agentiques avancées, notamment le contrôle de navigateur en temps réel, sont plus stables avec un modèle cloud en backend. Pour la génération de code, l’analyse de documents et les tâches de rédaction, le setup local avec Gemma 4 est pleinement opérationnel.

Peut-on intégrer Gemma 4 dans ses propres applications ?

Directement. Ollama expose une API REST locale au port 11434 compatible avec les bibliothèques officielles Python et JavaScript. Tu appelles le modèle exactement comme tu appellerais une API cloud, sauf que tout tourne sur ton infrastructure, sans frais d’usage et sans dépendance à un service tiers.