Pas besoin d’être ingénieur. Pas besoin d’écrire une ligne de code. Mais si vous ne comprenez pas ces cinq mécanismes, vous prenez des décisions sur l’IA comme on conduisait avant d’avoir appris ce qu’est un moteur, en espérant que ça tourne. Et en 2026, “espérer que ça tourne” n’est plus une stratégie.

À retenir

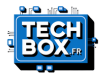

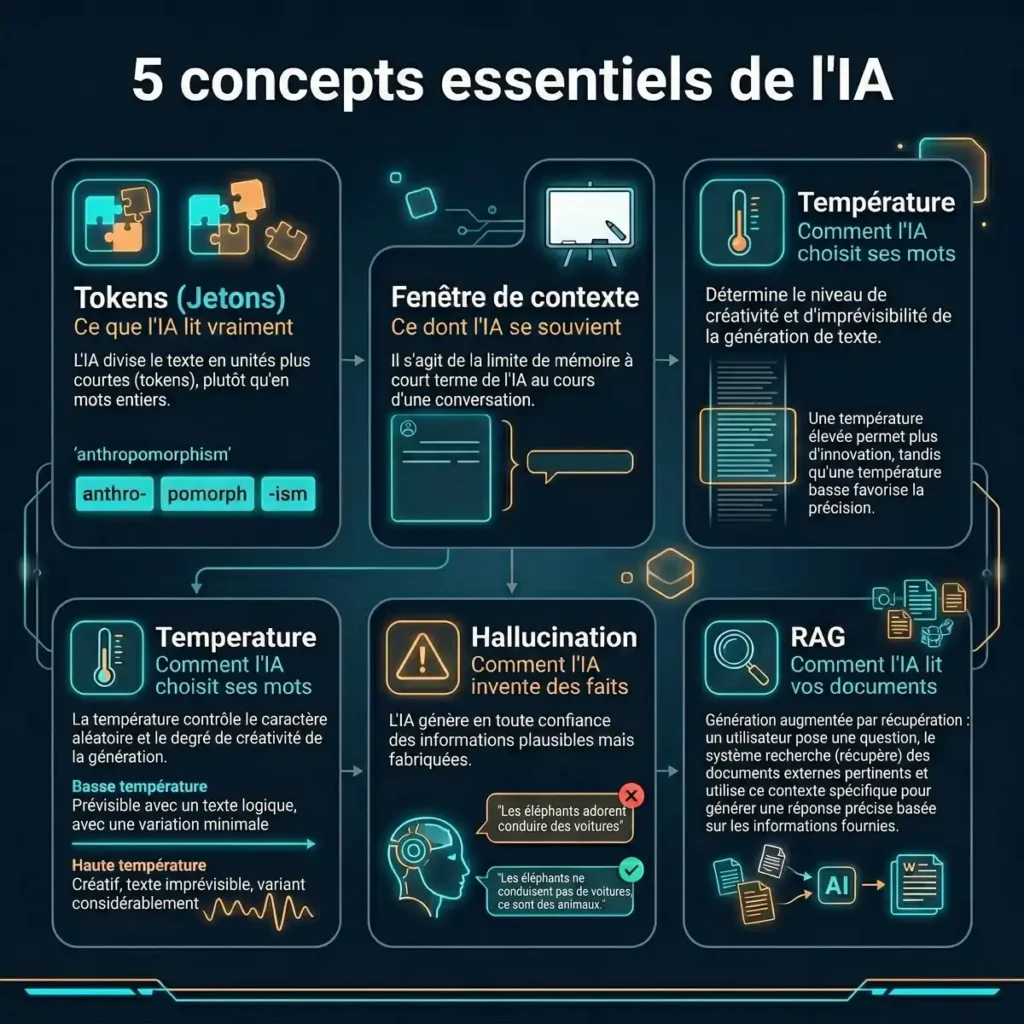

Cinq concepts séparent ceux qui subissent l’IA de ceux qui la pilotent : les tokens (ce que l’IA lit vraiment), la fenêtre de contexte (ce dont elle se souvient), la température (comment elle choisit ses mots), l’hallucination (comment elle ment sans le savoir), et le RAG (comment on lui donne accès à vos données). Comprendre ces cinq choses ne fait pas de vous un dev. Ça fait de vous quelqu’un qui arrête de se faire surprendre et qui commence à voir les erreurs des autres avant qu’elles coûtent cher.

Ce que l’IA lit n’est pas ce que vous écrivez

Commençons par quelque chose que presque personne ne sait, et qui change pourtant tout à la façon dont vous rédigez vos prompts.

L’IA ne lit pas vos mots. Elle lit des tokens, des fragments de texte qui peuvent être un mot entier, une syllabe, une ponctuation. “Intelligence artificielle” ? Probablement trois ou quatre tokens. Un contrat de 50 pages ? Des dizaines de milliers.

Pourquoi est-ce que ça vous concerne directement ? Parce que chaque modèle que vous utilisez (ChatGPT, Claude, Gemini) a une limite physique sur le nombre de tokens qu’il peut traiter en une seule fois. Cette limite, c’est sa fenêtre de contexte. Et quand vous dépassez cette limite dans une longue conversation, l’IA n’affiche pas de message d’erreur. Elle continue, souriante, en ayant silencieusement oublié le début.

J’ai appris ça de la pire façon. En 2023, je faisais analyser 300 pages de contrats à un modèle pour un client. Le résumé semblait parfait — structuré, précis, professionnel. Sauf que les 60 dernières pages avaient débordé la fenêtre de contexte. Le modèle avait comblé les trous avec des patterns plausibles. On a failli valider des clauses qui n’existaient nulle part dans le document original. Le client a eu la bonne idée de relire. Moi, j’aurais signé.

La fenêtre de contexte, c’est la taille du tableau blanc sur lequel l’IA travaille. Une fois plein, elle efface le passé pour écrire la suite, sans vous prévenir. Les nouveaux modèles poussent cette limite à des niveaux impressionnants (Gemini frôle le million de tokens, Claude dépasse les 200 000), mais la contrainte existe toujours.

Alors posez-vous la question : sur vos cinq derniers usages de l’IA, combien de fois avez-vous vérifié que le modèle avait bien tout lu ?

Le réglage que l’industrie vous cache et pourquoi c’est un choix

Il existe un paramètre appelé température. La plupart des interfaces grand public ne vous y donnent pas accès. Ce n’est pas un oubli. C’est une décision.

La température contrôle le degré de prise de risque du modèle dans ses choix de mots. Proche de zéro : l’IA sélectionne systématiquement le token le plus probable. Résultat ? Du texte précis, cohérent, un peu mort. Idéal pour résumer, coder, extraire des données. Proche de 1 et au-delà : l’IA explore des alternatives moins attendues. Elle peut produire quelque chose de brillant ou quelque chose d’absurde, mais elle ne produit jamais quelque chose de banal.

Voici ce que personne ne vous dira dans un webinaire “productivité avec l’IA” : les grandes plateformes règlent délibérément la température sur un point médian confortable, ni trop créatif, ni trop rigide, pour satisfaire le plus grand nombre. Résultat ? Vous obtenez du texte qui ressemble exactement à ce que des millions d’autres utilisateurs ont obtenu en tapant une requête similaire. Votre “contenu unique” est en fait la moyenne statistique de tous les contenus similaires qui ont précédé.

J’ai eu cette conversation avec un directeur marketing d’une scale-up qui se plaignait que ses textes IA “sonnaient faux”. Il avait raison. Mais la solution n’était pas de changer d’outil — c’était de comprendre que l’outil était réglé pour la médiocrité sécurisante, pas pour l’excellence risquée. Une fois le curseur ajusté via l’API, les résultats ont changé du tout au tout.

Si vous n’avez pas accès à ce réglage, sachez au moins qu’il existe et qu’il explique une bonne partie de vos frustrations.

L’IA ne ment pas. Elle prédit. C’est structurellement pire.

L’hallucination est le terme que tout le monde a entendu. Voici l’angle que presque personne ne défend, et que je vais défendre quand même : l’hallucination n’est pas un bug à corriger. C’est une caractéristique fondamentale de ce que ces modèles sont. Et les entreprises qui promettent de “l’éliminer” vous vendent soit de l’ignorance, soit du mensonge.

Quand une IA invente un livre qui n’existe pas, cite une étude fictive avec un DOI plausible, ou vous donne des statistiques confiantes sur un sujet qu’elle ne maîtrise pas, elle ne ment pas au sens humain du terme. Elle prédit le prochain token le plus probable en fonction de tout ce qu’elle a ingéré pendant son entraînement. Quand la réponse correcte n’est pas dans ses données, elle ne dit pas “je ne sais pas”. Elle génère ce qu’une réponse correcte ressemblerait.

Un jour, j’ai demandé à un modèle de citer trois experts d’un domaine de niche pour étayer un article. Il m’a fourni trois noms, trois affiliations universitaires, trois citations directes, tout parfaitement formaté. J’ai vérifié. Deux des trois personnes n’existaient pas. La troisième existait, mais n’avait jamais dit ce qui lui était attribué. L’article était pratiquement prêt à publier.

Ce qui est vraiment déstabilisant, c’est l’absence totale de signal. L’IA hallucine avec exactement le même ton assuré que lorsqu’elle a raison. Pas d’hésitation, pas de “je ne suis pas certain”. Juste une affirmation.

La leçon n’est pas “méfiez-vous de l’IA”. La leçon est plus chirurgicale : ne faites jamais de l’IA votre dernière vérification sur des faits à conséquences — juridiques, médicales, financières, éditoriales. Accélérateur, oui. Arbitre, jamais.

Pourquoi “votre” IA connaît vos documents et ce que cette phrase cache vraiment

Dernière pièce du puzzle, et de loin la plus mal comprise : le RAG, ou Retrieval-Augmented Generation.

Le pitch de presque tous les outils IA du marché en ce moment : “discutez avec vos données”, “interrogez vos documents”, “votre assistant qui connaît votre base de connaissances”. C’est du RAG. Et une fois que vous comprenez le mécanisme, vous comprenez aussi exactement pourquoi ça foire parfois et comment anticiper les échecs avant qu’ils arrivent.

Voici ce qui se passe réellement. Votre document est découpé en morceaux, convertis en représentations mathématiques (des vecteurs) qui capturent le sens plutôt que les mots exacts. Quand vous posez une question, le système cherche les morceaux sémantiquement les plus proches, les récupère, et les glisse dans le contexte du modèle avec votre requête. Le modèle génère une réponse basée sur ces extraits.

Le modèle n’a rien appris de votre document. Il a reçu les bons paragraphes au bon moment. La nuance est cruciale : si la découpe est mal faite, si les morceaux sont trop grands, si votre question est ambiguë, le système récupère les mauvais extraits. Et le modèle répond avec confiance sur des bases incorrectes. Ce n’est plus une hallucination classique. C’est quelque chose de plus sournois : une réponse logiquement cohérente construite sur les mauvaises données.

C’est la colonne vertébrale de presque tout ce qui s’est construit en IA appliquée ces deux dernières années. Chatbots de support, assistants juridiques, outils de recherche interne, RAG partout. Savoir ça, c’est savoir exactement où regarder quand ces outils échouent.

La conclusion que personne ne veut entendre

Voici ma position réelle, et elle est impopulaire : comprendre ces cinq concepts devrait vous rendre plus sceptique vis-à-vis de l’IA, pas plus enthousiaste.

Pas sceptique au sens “ne l’utilisez pas”. Sceptique au sens rigoureux du terme, capable d’évaluer ce que l’outil peut faire, ce qu’il ne peut pas faire, et ce qu’il croit faire sans en être capable.

Ces cinq mécanismes révèlent tous la même vérité : l’IA ne comprend pas. Elle calcule des probabilités sur des patterns, à une échelle inhumaine, avec des résultats qui ressemblent à de la compréhension. C’est extraordinairement utile. C’est aussi extraordinairement facile à surestimer.

Le fossé qui se creuse n’est pas entre ceux qui utilisent l’IA et ceux qui ne l’utilisent pas. Il est entre ceux qui savent exactement ce qu’ils ont entre les mains et ceux qui font du vaudou numérique en espérant que ça tourne. Les premiers prennent de meilleures décisions, détectent les erreurs avant qu’elles coûtent cher, et construisent des workflows qui tiennent.

Les seconds publient des articles avec des experts qui n’existent pas.